制造过程监测中的多传感器测量与数据融合技术

-

摘要:

综述 ● 开放获取阅读更多

摘要

随着精密制造技术的迅速发展,为提高制造的效率和精度,科研人员在多传感器测量和数据融合技术领域开展了大量的研究工作以提升监测系统的测量精度和信息丰富性。多传感器系统中的每个传感器都能独立地测量某些物理参数,然后系统通过采用特殊的信号处理算法,将所有独立的测量结果组合成一套完整的测量结果。本文较为系统的介绍了多传感器测量与数据融合技术及其在精密监测系统中的应用。论述了多传感器测量系统的体系结构,并列举其在制造系统中的一些实际应用;同时,总结了相关的数据融合方法和算法。最后对多传感器监测和数据融合技术的未来发展进行了展望。

1.引言

自动化生产因其灵活性和高效性,是工厂生产的重要方式。对零件加工日益增长的加工精度的需求,催生了自动化加工过程更好、更精确控制的要求 1,这主要是受全球竞争加剧、产品生命周期缩短以及产品需求多样化的影响 2-4。为了满足日益增长的产品需求,制造商们越来越多地转向自动化加工系统,这可以减少生产过程中对操作员的依赖。自动化加工系统的实现主要依赖于可靠、稳定的监测系统用来对关键性加工过程进行在线和离线的监测。

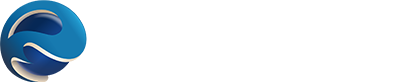

传感器是一种广泛使用的物理设备,通常由输出电流来响应物理激发。如图1所示,现代仪器系统往往配备许多不同的传感器,每个传感器都有自己的独立功能。监测系统中的每个传感器都可以独立测量某一物理参数,并通过使用特殊的信号处理算法将所有独立的测量值组合成一套完整的测量结果,这种系统被称为多传感器系统5-8。例如,通过使用一个多传感器系统来监测金属切削操作和控制机床,可以显著减小加工误差并获得更佳的产品表面质量。这种方法越来越多地应用于低成本、功能强大的微处理器。同时,传感器利用信号处理系统和数字闭环控制更具经济性9-11。因此,多传感器系统是提高加工精度的重要组成部分。

2.研究背景

为满足不同要求和测量参量,现代仪器系统往往需要配备多个不同的传感器,每个传感器都有其独立的功能。多传感器监测系统中的每个传感器都可以独立测量某个参数,并通过特殊的信号处理算法来组合所有独立的测量值以提供最终完整测量结果。为了降低微处理器的成本,现在多传感器系统的使用越来越广泛。同时,传感仪器使信号处理系统和数字闭环控制非常经济适用。此外,在多传感器系统中,实现系统功能的关键是协调好所有传感器的信号。将所有传感器的测量数据综合起来,利用特殊的算法对测量结果进行完整性和一致性描述,这一过程称为多传感器数据融合。该技术可以提高可检测性与可靠性,扩大时空感知的范围,降低推理模糊度,提高检测精度,增加目标特征维数,提高空间分辨率,并增强系统的容错能力等。孔令豹研究员详细介绍了多传感器系统和数据融合技术的应用。

图1. 智能多传感器系统框架

在多传感器系统中,实现系统功能的关键是各传感器之间的协调配合。图1展示了具有多传感器功能的智能系统的总体框架。在多传感器系统中,传感器将测量数据提供给数据融合层,数据融合层采用先进信号处理算法将信息融合成一个整体,进一步地,系统通过控制应用程序向执行器提供充足的控制信号12。这种将所有传感器的测量数据组合起来并利用特殊算法进行融合来提供完整测量值的过程称为多传感器数据融合13-20。目前,数据融合技术已成为国际研究热点之一。数据融合充分利用多个信息源,在空间或时间上组合互补或冗余的信息。通过使用特定的标准,数据融合可以获得对被测对象的一致性解释,从而使信息系统的性能优于由其子集组成的系统。数据融合利用数学方法和技术工具综合不同的信息源,获得高质量、丰富有用的测量数据。与单一信源的独立数据处理相比,数据融合的优势在于提高了系统检测的可检测性和可靠性,扩大了时空感知范围,降低了推理的模糊度,提高了检测精度,增加了目标特征的维数,提高了空间分辨率问题,并提高了系统的容错能力 21-34。

本文通过介绍多传感器过程监测系统的体系结构和应用广泛的数据融合算法,详细论述多传感器测量与数据融合技术,并介绍多传感器系统的一些实际应用。文章第二节详细介绍多传感器监测技术,第三节总结不同的传感器融合算法,第四节讨论多传感器过程监测系统和数据融合技术的发展前景,最后的第五节为结论部分。

2. 多传感器监测技术

2.1 增材制造监测系统

与减材制造工艺相比,增材制造是一种极具竞争力、高自由度的制造技术35-37。增材制造技术具有许多优点,包括能够缩短产品开发时间、生产复杂的定制组件、修复各种机械部件和制造各类自由形式组件等38-39。尽管增材制造技术具有上述优点,其仍被认为具有较大局限性,包括制造的质量和可重复性。与传统的制造相比,增材制造的缺陷率仍然很高。为解决这个问题,最近的许多专题研究和项目方案都优先开发过程监测方法40-45。根据ASTM标准F2792-12a,增材制造工艺可分为七类:粘合剂喷射、材料挤压、光固化、材料喷射、薄片层压、直接能量沉积(DED)和粉末床熔融(PBF)46。

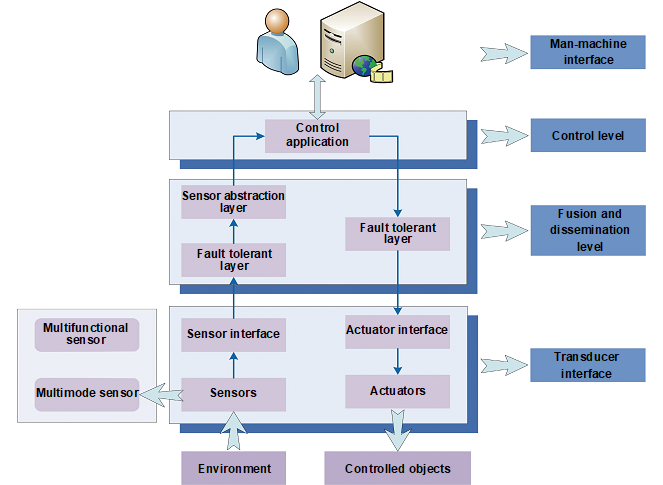

如图2所示,粉末床熔融系统采用粉末沉积法,粉末层分布在基板和粉末贮存器上。粉末均匀分布后,PBF系统利用激光或电子束的热量,根据三维(3D)模型扫描切片各层的几何结构。一层加工完成后,降低加工平台高度,并连续执行制造过程。

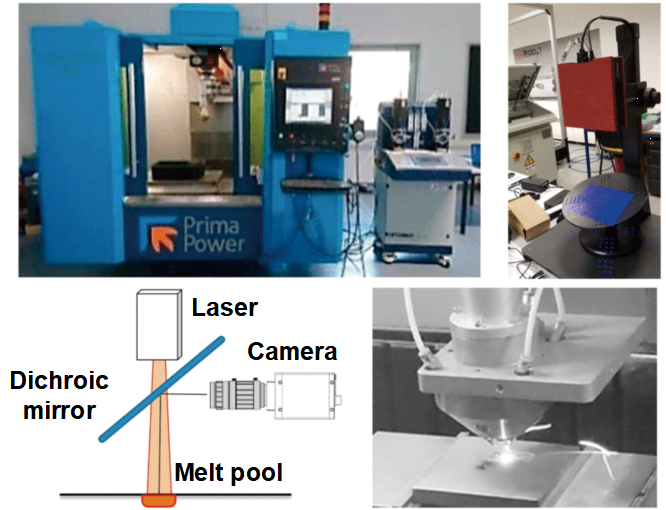

图2. 粉末床熔融系统示意图(加工腔室)43

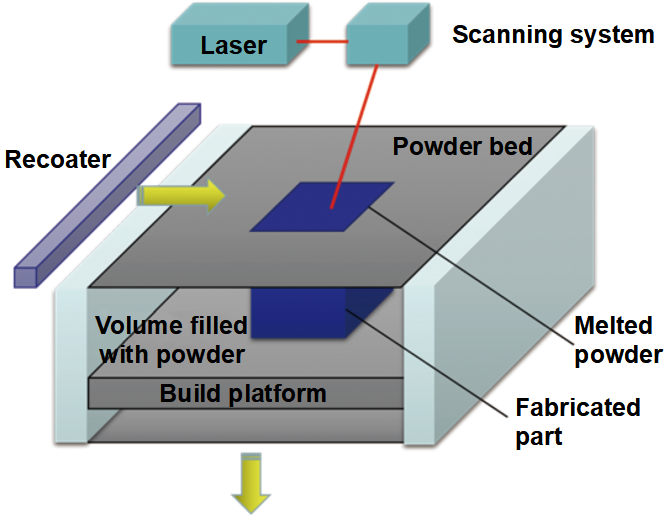

在增材制造的过程监测系统中,主流的传感器和原位数据测量设备可分为以下几类:非接触式温度测量、可见光成像和低相干干涉成像。此外,传感器的安装方法可分为离轴和同轴两种。在离轴结构中,传感器安装在光路之外,相对于被监测区域具有偏转角度。在同轴结构中,传感器可以方便地监测能量源所在光路。图3所示为增材制造过程监测系统设置。光学监测装置由近红外互补金属氧化物半导体(NIR-CMOS)相机和光电二极管组成 47-50。在制造过程中,激光束被半透半反镜反射到扫描器上。同时,对400-1000nm波长敏感的传感器1和传感器2,通过利用分束器来捕获熔池发出的辐射,然后将熔池的辐射强度积分为一个测量值。近红外CMOS相机具有1280×1024像素,速度为10khz的传感器,用于确定熔池在制造过程中的形状和温度分布。然而,为了达到10 kHz的采样率,必须将视野缩小到一个有限的区域。

图3. 多传感器监测系统示意图44

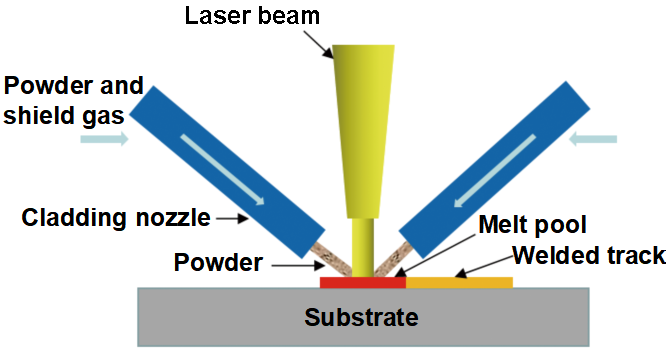

直接能量沉积工艺是一种金属增材制造工艺,通过在沉积过程中熔化材料来创建三维组件。根据送料机理,电火花加工可分为送丝和送粉两大类。如图4所示,与图2所示的粉末床熔融系统不同,直接能量沉积系统不熔化先前放置在粉末床上的材料,而是用于熔化沉积的粉末材料。在制造过程中,直接能量沉积增材制造系统在惰性保护气体环境中通过使用高功率激光将熔覆喷嘴输送的粉末熔化51-54。

图4. 粉末送料机构直接能量沉积工艺示意图52

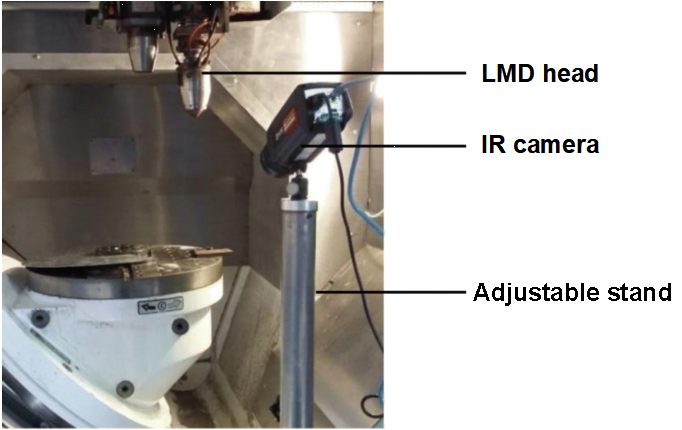

直接能量沉积工艺专门用于制造功能性金属零件。直接能量沉积增材制造系统的能量输入可由电弧和高功率激光提供,沉积材料可为粉末和金属丝。直接能量沉积工艺是在开环环境下进行的,其存在有生产损失和缺乏可重复性等缺点。因此,为了提高直接能量沉积系统的性能,研究并利用加工过程光学监测系统对制造过程进行实时控制,保证最终零件的高质量。目前,有一些研究致力于设计一个单闭环控制系统,用于控制材料的输送、激光能量、热分布等。由于一些监测系统仅限于控制一个指标,因此提出了多传感器监测系统的设计方法。但设计的多传感器监测系统仍然只关注一个现象,主要就是直接能量沉积过程中的几何现象。在研究54中,提出了一种新的多传感器方法,用于监测至少两个直接能量沉积过程。如图5和图6所示,研究主要集中在闭环热控制和闭环几何控制。在丝弧增材制造(WAAM)和激光金属沉积(LMD)制造单元中设置了红外摄像机,用于制造过程中的全局热成像。显然,红外摄像机安装在远离熔化区域的地方,以获得足够大的制造零件成像视场,并保护摄像机在复杂的加工环境中免受潜在损坏。

图6. 丝弧增材制造中使用的热监测装置54

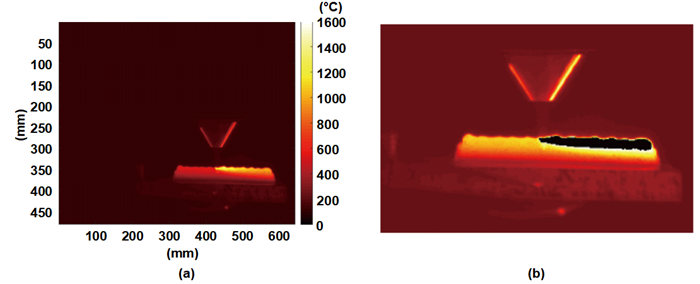

研究者为了校准用于热成像测量的热成像摄像机,进行了初步试验。不锈钢材料的发射率设定为0.7。关于从红色、绿色、蓝色(RGB)到温度的转换,相机根据发射率值直接提供与物体温度成比例的值。同时,丝弧增材制造和激光金属沉积应用的图像分辨率分别约为0.5mm/像素和0.2mm/像素。如图7(a)所示,使用红外摄像机获取现场热数据。如图7(b)所示,高温区(HTZ)以黑色突出显示。由于液相转变导致发射率特性的局部下降,在熔池位置测得的温度明显低于预期。在图7(b)中,可以注意到高温区正沿着火炬路径行进。

图7. 激光金属沉积制造中的现场热监测B:(a)热场;(b)高温区(HTZ)54

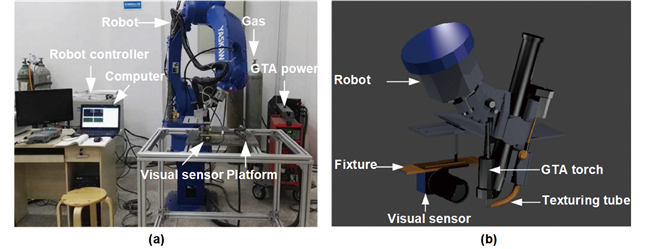

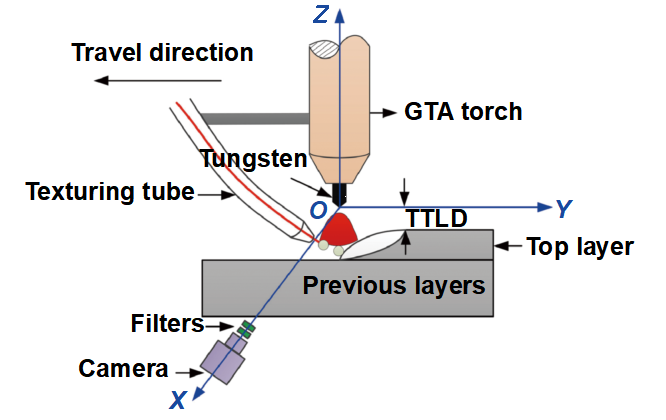

丝弧增材制造技术能够通过以金属丝的形式连续沉积层来制造致密元件,因而受到了广泛的关注。同时,沉积高度被认为是影响金属沉积的一个关键因素,在机器人气体钨电弧(GTA)增材制造工艺中,沉积高度的自动检测方法是可行的。例如,如55所述,安装的光学滤光片和相机监测沉积高度,定义为钨尖到顶层的距离。此外,采用特殊设计的图像处理算法提取熔池的特征参数。通过设计一种新的跟踪算法,对连续图像进行分析,确定了熔池固液分离的位置。最后证明了该跟踪算法在基于气体钨电弧的增材制造过程中具有良好的跟踪效果和抗干扰能力。如图8(a)所示,基于气体钨电弧的机器人系统主要包括MagicWave 3000 Job G/F粉末设备、Motoman MH24六轴机器人、KD4010送丝设备等。图8(b)分别显示了气体钨电弧焊枪和光学传感器的位置。

图8. 基于气体钨电弧的机器人增材制造系统:(a)实验系统和(b)气体钨电弧嘴与视觉传感器之间的位置55

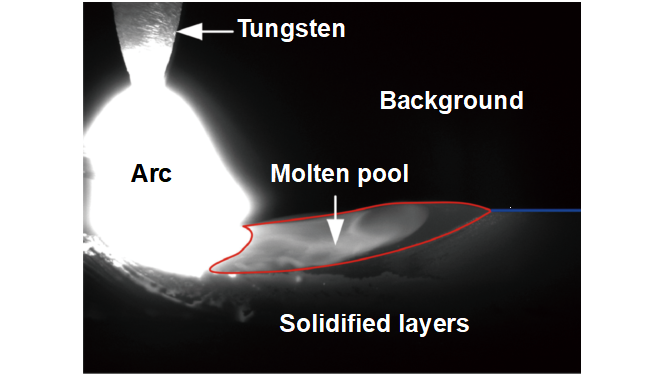

如图9所示,视觉传感器由两个过滤器和一个摄像机组成,传感器用于观察电流层和钨尖。传感器在制造过程中捕获的图像如图10所示。图像分为五个区域:背景、固化层、钨、电弧和熔池。圆弧区域的灰度值等于255,而背景区域的灰度值等于0到15。随着界面灰度值的急剧变化,在当前的制造层中可以方便地识别出熔池。

图9. 钨尖到顶层距离(TTLD)的定义及视觉传感系统原理图55

图10. 在基于气体钨电弧的机器人增材制造系统中捕获的图像55。

在文献56中,所使用的MER-125-30UM-L相机传感器的采样率为30fps,能够捕获1292×964像素的图像。同时,钨尖与透镜的距离为130mm,透镜的焦距为35mm。为了防止相机在复杂的制造环境中受到强烈的辐射,相机前面安装了调光玻璃,使相机具有合适的孔径,可以获得高质量的熔池图像。由于沉积区主要在高温条件下发出红光,因此在摄像机前安装了中心波长为685nm的滤光片,保证了熔池和制造层的高对比度图像。利用窄带滤光片,只有685nm的光谱可以通过,传感器捕捉到的图像由685nm的强度和接近该波长的部分组成。

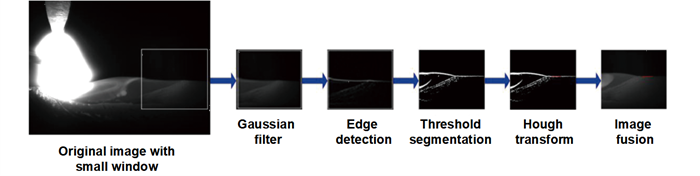

在监测的图像中,钨尖的位置是固定的,因为相机传感器安装在气体钨电弧焊枪上。主要的挑战是确定用于测量钨尖到顶层距离(TTLD)的层边缘。通过设计的图像处理算法,可以从采集到的图像中提取出层的表面特征。如图11所示,气体钨电弧增材制造过程中的图像处理包括几个过程,例如高斯滤波过程、边缘检测、阈值分割、Hough变换和图像融合。如56所示,原始图像由一些设计的算法处理,高斯滤波器用于去除噪声,Hough变换用于顶边拟合。一旦得到曲面的行坐标,就可以根据行偏差计算钨尖到顶层的距离。

图11. 基于气体钨电弧的增材制造系统中确定钨尖到顶层距离的图像处理56

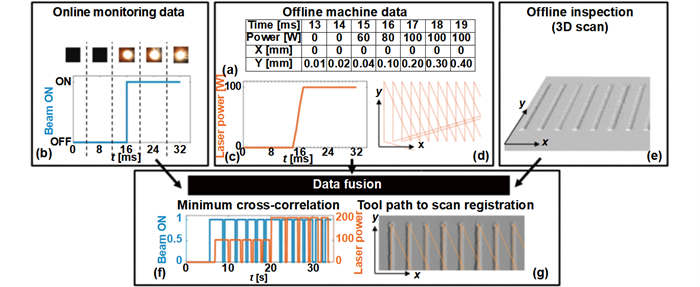

通常,增材制造涉及到各种复杂的物理现象,需要采用复杂的过程控制策略来实现金属零件的高级力学性能。此外,与其它金属增材制造技术相比,直接能量沉积技术的复杂性更高。直接能量沉积技术具有更大的灵活性和高效性,但其过程控制难度更大。在文献57中,提出了一种多传感器方法,在检测零件质量时,将在线信号与离线检测设备的数据相结合。此外,这种过程融合的数据融合方法形成了过程建模阶段的基础,因此,该方法为实现通过跟踪零件尺寸和机械质量来调整机械加工参数的智能控制策略奠定了基础。通过在直接能量沉积机床上的特殊实验,评价了该方法的优越性。

本研究的主要内容是将沉积过程中及沉积后不同传感器采集到的各种数据进行融合。有一些数据可以利用,如在线机器跟踪,包括激光位置、激光功率和移动速度。同时,将熔池的热测量和特征作为在线监测的内容类别。此外,还有一些关于离线检测的问题,如显微镜下的孔隙率、三维重建等。

在制造过程中,监控数据可以是空间参考和时间参考。这两种情况下,使用不同的分辨率。同时,由于信息的异构性,必须采用综合数据融合方法来充分利用信息。如图12所示,数据融合的流程非常清晰,这种数据融合方法充分考虑了通过实验设备获得的数据。摄像机高速采集熔池图像,同时机器可编程控制器(PLC)记录激光光斑位置和激光功率。此外,每次沉积后,对所得样品的几何结构进行三维扫描,这些数据随后在空间维度或时间维度上被记录和整合。

图12. 数据融合方法. 在机器日志文件(a)中,每一个印记都记录了刀具位置和激光功率。该信息用于熔池图像的时间对准(f),用于计算图像检索到的光束打开信号(b)和激光功率信号(c)之间的互相关,以及用于将工具轨迹(d)的空间注册(g)到3D沉积几何体(e)57

如图13所示,用于当前研究的实验设备是Prima Power LASERDYNE®430三轴计算机数控(CNC)机床。三轴数控机床最初是为激光切割操作而设计的,后通过将四喷嘴的光导头与前视红外(FLIR)摄像机集成,改造成增材制造机床。将FLIR相机安装在沉积头上,利用光学通道中的二色镜对熔池进行监控。对于离线测量,GOM-ATOS-Core 200条纹投影扫描仪可以提供代表零件表面的三维网格。

图13. 设备介绍:直接能量沉积机器(左上)、3D扫描仪(右上)、监控高速摄像机熔池(左下角)和沉积头(右下角)57

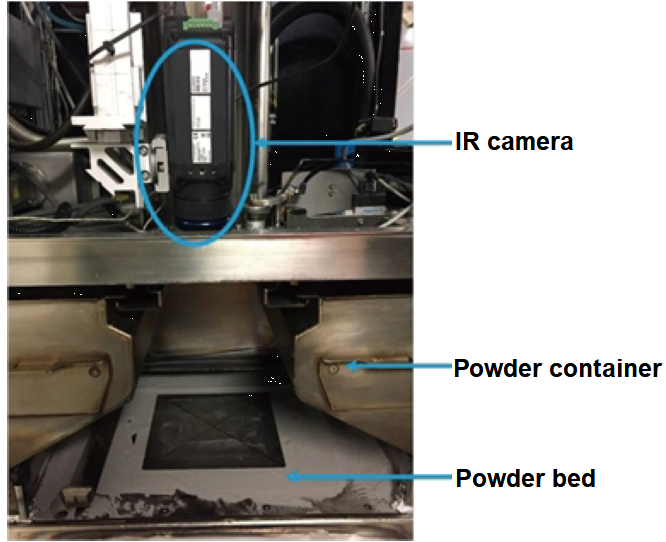

随着复合材料技术和构件嵌入技术的发展,一种用于制造增强型或多功能零件的增材制造技术应运而生。当前技术下,零件制造过程通常需要中断和零件拆卸,这一过程被称为停产制造,而零件在恢复制造前,进行重新定位的过程中可能会出现位置误差。在电子束熔炼(EBM)系统中,制造环境是一个重要的挑战——超高真空高达10-4托,加工温度高达800℃,这限制了电子束显微镜进入到EBM加工腔室。在研究58中,基于红外图像的零件定位技术被成功开发用于EBM制造系统,以减少停产制造和继续制造过程中的位置误差。该研究中,红外成像技术被应用于矩形棱柱和圆柱形组件的停产制造和继续制造过程,在制造完成后,测量了矩形棱柱体和圆柱形构件的角位移和线位移,其绝对最大值分别为0.87mm和0.17mm。因此,红外图像分析技术可以有效地应用于复合材料制造、增材制造等领域。

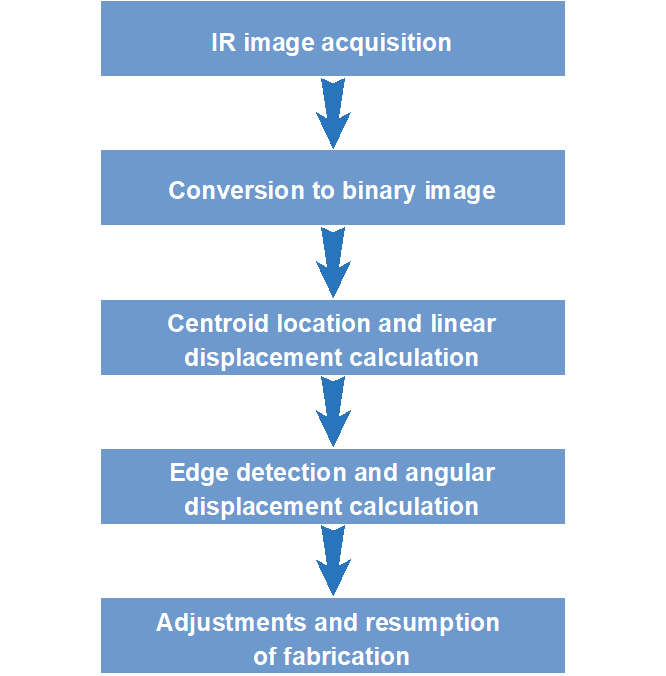

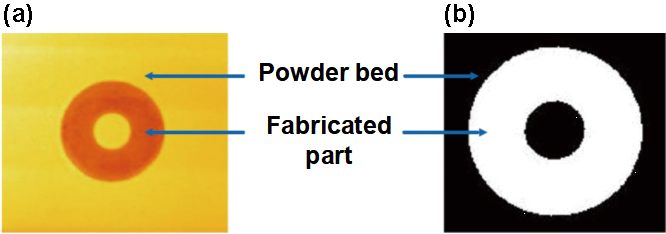

在该系统中,必须考虑和确定相对于粉末层中零件的预期光束位置(x-y点),以便精确建立在前一层的基础上。如图14所示,红外摄像机安装在制造室外部,红外图像分析算法使用MATLAB®软件设计,以提取零件的旋转和质心位置,可以有效计算零件的角度和线性偏移。如图15所示,红外图像分析方法的流程图分为五个步骤:红外摄像机采集红外图像,然后将其转换成二值图像,用于计算质心位置和位移,最后再利用分析算法检测零件边缘并计算角位移,更新计算机辅助设计(CAD)文件。

图14. 红外摄像机设置58

图15. 零件定位技术示意图58

图16给出了将红外图像转换为二值图像的示例。通常,二维图像可以看作一个c列r行的矩阵,矩阵中的每个位置(r,c)都与图像中的一个像素相关。在每个像素中,二进制图像都可以用黑白来描述,而彩色图像则可以用三个16位值来表示,包括红色、绿色和蓝色。在本研究中,使用白色像素(像素值=1)指定在制造过程中捕获零件图像的区域,而使用黑色像素(像素值=0)表示背景。此外,还可以从二值图像中找到零件的边界,从而有效测量零件的旋转和质心位置的变化。 研究中采用二值化图像来检测零件边缘,其具有成本低、使用方便的特点,RGB彩色图像则可用来探索更多的方法。

图16. 装配零件的图像:(a) 红外图像和(b)转换的二值图像58

2.2 激光焊接系统

在激光焊接过程中,材料与激光束相互作用,产生一系列不同的过程特征信号,包括这些特征信号可能包含的空气与结构传播的声发射,激光束在作用区域的反射,钥匙孔、熔池和母材及其上方金属蒸气的发射信号59。

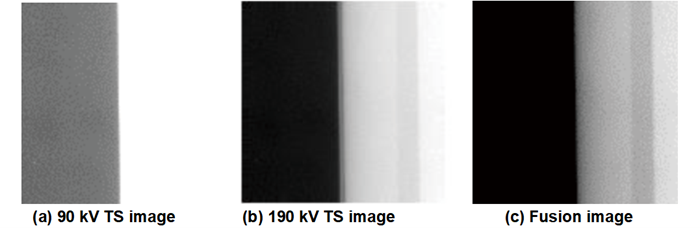

在研究59的工作中,第一种监测方法研究了与这些过程释放相关的光学信号,光电二极管、传感可见光和近红外(NIR)发射,被用来监测激光感应以及激光相互作用区域的辐射发射;研究了这些信号与未焊透、气孔等不同类型焊缝不连续性的相关性。光电二极管的优点是成本低,能够探测宽波长范围(从紫外线(UV)到红外)的过程发射,适合在工业制造环境中使用。一般来说,研究已经确定了200-850nm的光电二极管光谱范围,适用于分析激光相互作用区的发射。文献64利用响应可见光或近红外发射的光电二极管建立的基于光学的监测方法,将光电二极管信号与不同类型的焊接特征、缺陷和工艺异常关联起来,包括内部孔隙的出现、穿透深度的变化和光束对接缝的对准、激光功率的变化,以及清洁度或填充度的降低。此外,还有一种基于激光干涉测量的新型商用过程监测方法,用于测量小孔深度。这两种方法的结果证实了这些监测技术最敏感的焊接特征、缺陷和/或工艺异常的类型,并有可能在未来的多传感器实时过程控制解决方案中成为现实。

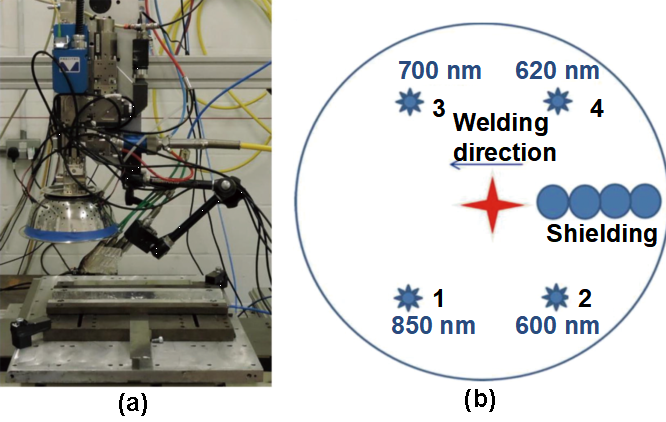

如图17所示,在焊接试验中使用了连续波5kw Yb光纤激光束源(1070±10nm)。激光束通过0.15 mm的芯径光学纤维传输到由100 mm焦距准直光学元件和200 mm焦距聚焦光学元件组成焊接头,在焦点处提供0.3 mm标称直径光斑。在焊接之前,使用水冷Ophir功率计测量工件的激光功率,在焊接头中集成在线深度测量系统(IDM)。头部本身固定在一个安装板上,而安装板连接到一个z轴上,Aerotech ATS50045线性工作台用于在x-y平面上移动头部下方的工件,头部的设置使得光束垂直于工件表面,顶珠和底珠采用氩气保护。IDM传感器能够以高达70 kHz的采样率获取匙孔深度数据,测量深度高达10 mm,焊接头上的准直装置允许测量光束的焦点位置进行z调整,并允许其与焊接小孔对准的x–y进行整体位移。RS422接口用于在PC端运行的软件中进行实时数据传输。

系统使用四个光电二极管,选择不同的窄带通滤波器,每个传感器一个,以600、620、700和850 nm的波长为中心。利用数据处理软件对光电二极管信号进行分析,该软件包括一个数据处理单元,显示器、键盘和鼠标与之相连。第二个单元由数字通道组成,光电二极管可以通过BNC连接器连接到数字通道(每个通道一个)。在试验期间,数据采集在32768 Hz(2N,N=15)下进行,四个光电二极管及其相关滤光片被固定在焊接头上半球形金属支架的激光小孔周围。图17(a)是实验室设置的图像,包括焊接头、IDM和四个光电二极管。图17(b)是光电二极管相对于焊接方向和焊接时使用的随动保护气体管道的径向定位示意图,光电二极管对准键孔顶部,与工件表面呈大约45°的角度。

图17. (a) 设备设置的图像,包括焊接头、加工深度计(IDM)和四个光电二极管。(b) 显示光电二极管相对于焊接方向和保护气体管道的径向定位的草图64

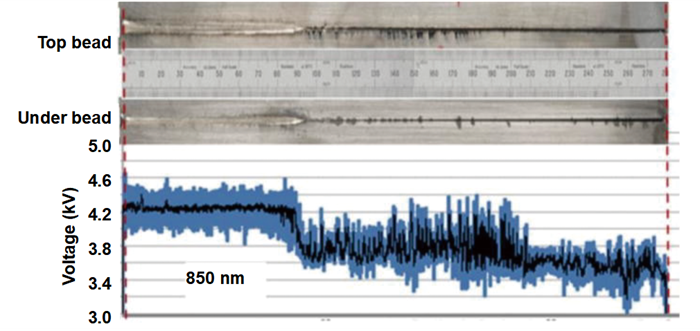

图18显示了700纳米光电二极管由同一合金中受油脂污染的对接焊缝产生的结果,在焊接试验期间没有应用背景信号校正。在本实验中,激光功率从1千瓦增加到2千瓦,600、620和850纳米光电二极管取得了类似的结果。在关节污染的情况下,可以观察到被污染的关节长度相对应的局部信号噪声增加。因此,信号噪声可用于推断受污染的关节长度。

图18. 镍(镍)合金718对接焊的上焊道、下焊道和700纳米光电二极管信号数据中间第三段被油脂污染了64

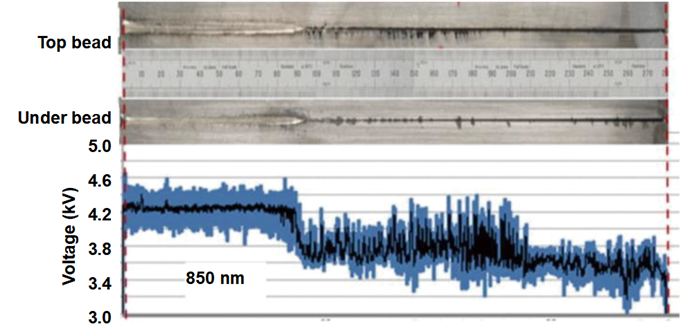

图19提供了来自同一合金对接焊缝的850 nm光电二极管数据的示例,该对接焊缝在宽度从0 mm(焊接开始处)到1 mm(焊接结束处)逐渐打开的间隙上焊接。在这种情况下,使用2千瓦的恒定光束功率,而600、620和700纳米光电二极管也取得了类似的结果。当两个相邻工件之间存在接合间隙时,可观察到平均光电二极管信号值降低,同时由于光束与接合下面的焊接夹具相互作用,其噪声增加。同样,这种信号的变化可以用来推断关节间隙过大。

图19. 在逐渐打开的接头间隙上焊接时,镍合金718对接焊缝的上焊道、下焊道和850 nm光电二极管信号数据 64

在激光焊接系统中安装过程监测设备,是提高生产效率和保证稳定性的关键。在焊接过程中可以观察到一些现象,如光发射、应力波和光学成像65。在过程监控系统中,为了测量更多的过程特性,将一些传感器集成为一个整体。例如,在66中,Zhang等人用接触探针测量等离子体电压,测量电荷强度,分析等离子体行为。在67中,根据焊接条件,同时测量并分析红外和紫外信号。在68,69中,在不同的角度安装两个波长为950nm的红外光电二极管来测量等离子体现象。在70中,P、T和R传感器用于测量后向散射激光、熔池和等离子体光。Park等人71,72利用光电二极管测量实验参数,研究等离子体信号与焊接质量的关系。此外,Sibilano等人73分析了铝激光焊接等离子体的光谱,Palanco74则分析了铝激光焊接等离子体的光谱。为了控制焊接熔深,Jauregui75在激光焊接过程中使用了四个光电二极管进行检测。

如76所述,开发了一种监测系统,用于测量等离子体信号,以监测激光焊接过程,利用光谱信息分析铝合金与激光之间的等离子体发射特性。通过实验,建立监测信号与工艺参数之间的关系,并利用监测信号对焊接质量进行预测,采用神经网络模型结合模式识别算法对拉伸强度进行预测,并设计用户界面,方便了该算法的使用。

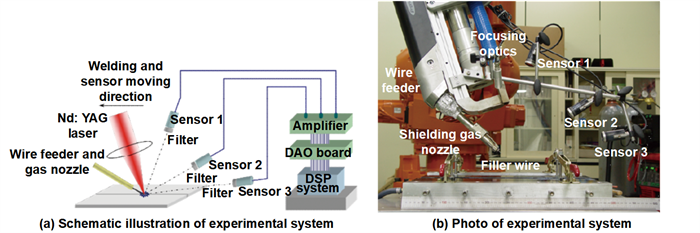

图20显示了激光焊接的实验装置,该装置利用在激光移动方向前方提供的填充丝,并且Nd:YAG激光的最大输出功率为4.4kw,激光器从垂直方向倾斜约18度,以保护光学部件免受反射激光的损坏。通常,为了提高焊接件的质量,在焊接过程中对焊缝熔深进行监控是必不可少的。由于无法从可连接、可移动的正面传感器直接观察到熔深,因此对焊缝熔深的监测是一个很大的挑战。因此,由于前端传感器可以测量焊缝熔深内在对应的信号,成为许多研究者关注的课题。

在77中,采集并分析红外图像,说明了焊枪位置、焊道宽度和焊缝熔深之间的关系。在〔78〕中,Carlson等人利用超声信号估计侧壁穿透力。在79中,Wang等人回顾了三维熔池测量。此外,在文80中,还设计了三维视觉传感系统,并在钨极气体保护焊(GTAW)系统中进行演示,该系统可以对熔透后的熔池表面进行测量,从而对三维镜面熔池进行光谱测量,这种方法被认为是很有前瞻性意义的,因为熟练的焊工可以根据对焊接熔池(主要是三维表面)的观察去成功估计和控制焊接熔深。文献80将一些正面信号作为特征,如熔池的长度、宽度等,以提高对焊道宽度的预测。结果表明,由于训练数据的生成成本较高,如何从少量的训练数据中建立精确的模型是关键问题。

图20. 激光焊接与监测系统的实验装置76

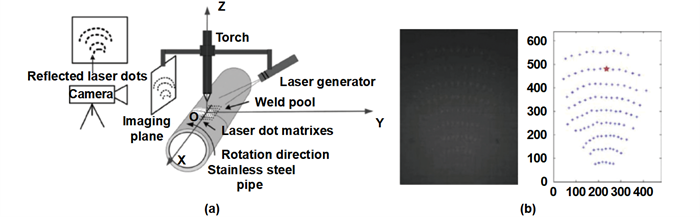

在肯塔基大学的焊接实验室,为钨极气体保护焊工艺设计了一个实验系统,如图21所示。GTAW焊接采用304不锈钢,其管壁厚2.03mm,外径113.5mm,用波长为684nm的20mw激光产生19×19点阵激光图样,这样熔池很容易反射。在电弧产生的等离子体作用下,熔池表面发生变形和凹陷,导致反射点基体变形。如图22(a)81所示,通过有效利用图像处理来重建三维熔池。然而,为了提高对焊道宽度的准确预测能力,需要更多的非线性建模方法来克服实验所需大量训练数据集的限制。因此,在文献81中提出了一种支持向量模型,利用核函数有效地减少实验数据。

图21. 基于三维视觉的监控系统。(a) 传感系统和(b)捕获图像80

图22. 三维熔池表面及其特征参数。(a) 展示了熔池的三维重建,(b) 熔池表面凸度,和(c)熔池宽度和长度81

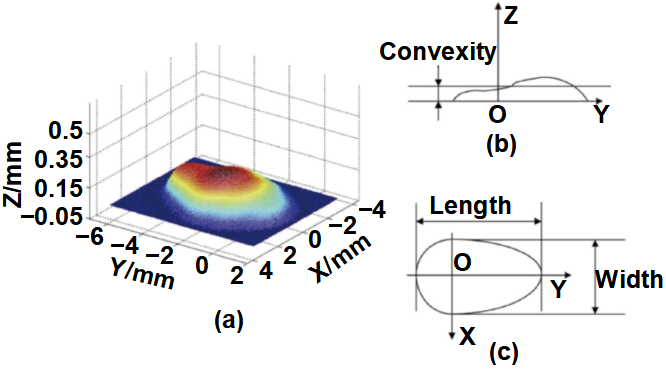

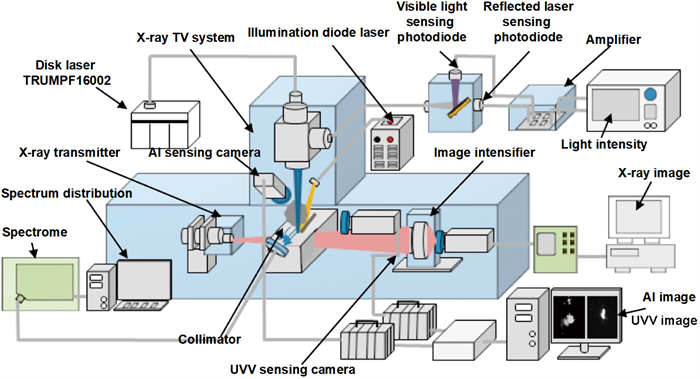

目前,多传感器技术在激光焊接领域得到广泛应用。文献83利用X射线透射成像设备和高速摄像传感器对焊接过程进行观察,分析了焊接速度和激光功率密度对焊接成形的影响,焊接宽度和熔池大小可通过接收到的辐射强度进行直接监测82,83。在文献84中,利用光学滤波器和光电二极管研究了焊接速度对高频信号的影响及其与高频的关系,获得了焊接过程中的激光反射和可见光辐射。在85中,光谱仪用于获取光谱分布,高速摄像机用于捕获锁孔图像;同时,通过提取参数,对焊缝熔深和焊缝宽度进行检测。You等人86在激光焊接过程中运用多种传感技术,量化各种物理和光学特性,全面分析了激光焊接的缺陷。研究中,如图23所示,通过提取和分析6个成像传感器的特征,建立识别模型,并对焊接状态进行预测,从而实现了对大功率激光焊接的实时监控。该系统采用可见光波段和紫外波段的高速摄像传感器对304不锈钢激光焊接过程中的羽流图像进行采集。此外,熔融图像由X射线成像系统和近红外波段捕获,利用激光传感光电二极管和可见光光电二极管分别获得了激光反射强度和可见光强度,通过提取不同激光焊接条件下的光信号,分析了焊接条件与焊接特征之间的关系。

图23. 激光焊接六传感器监测系统示意图86

如图23所示,多传感器系统包括紫外线/可见光视觉传感器、X射线视觉成像传感器、光谱图、可见光光电传感器、激光反射光电传感器和辅助照明视觉传感器,从而实现激光焊接过程的实时探测和分析。同时,多传感系统和焊接系统可以通过安装在工作台下并与信号箱相连的触发传感器同步,为传感系统和激光加工系统提供触发信号。

此外,利用高速摄像传感器和视觉感应滤波器,分析金属飞溅和羽流的特性,可以获得金属飞溅和羽流图像。同时,利用波长为976nm的40W半导体激光器和装有窄带滤光片的高速摄像机,可以获得熔池图像,以分析熔池的特性。通过将两根光纤连接到激光头上,焊接区域的光强度可以传输到分光器,激光反射强度和光强度可以分别由两个光电传感器获得。X射线从焊件左侧发射,穿透整个焊接区域。材料密度的不同导致X射线的衰减程度不同。另外,光谱仪准直器设置在焊接方向的前方,聚焦于等离子体区,通过光纤接收光谱信息。

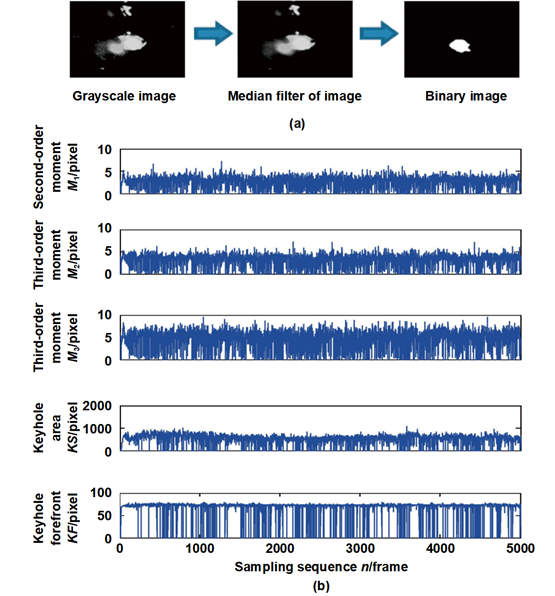

图像的二值化处理如图24(a)所示。利用中值滤波去除噪声,可以将彩色图像成功地转换成二值图像。在二值图像中,提取了键孔前沿(KF)和键孔顶部区域(KS)的坐标值,以更充分地描述特征,如图24(b)所示。此外,在研究87中,六个传感器产生了42个特征,并获得了具有焊缝宽度的熔深作为焊接参数。对16个最接近焊接状态参数的关键特征进行关联分析,并对焊接参数与关键特征之间的关联规则进行定量分析。在不同的激光焊接条件下,通过一系列的实验,揭示了焊接特征、焊接条件和焊接状态之间的关系。所形成的焊缝在不同的状态下产生,如爆裂、隆起、凹陷和稳定。为了识别焊接状态,基于关键特征建立了贝叶斯网络缺陷检测模型。预测精度高达86.04%的树增广朴素贝叶斯网络模型比马尔可夫贝叶斯网络模型高了10.92%。

图24. 人工智能视觉传感信号处理。(a) 小孔成像过程和(b)小孔的配置参数87

2.3 铣削系统

铣削是一种常见而有效的切削加工工艺,使用带有一个或多个齿的旋转刀具将零件加工成螺纹、平面和其他复杂的零件。由于适合于大规模生产,铣削加工在工业生产中得到了广泛的应用。刀具是铣削过程的关键88,刀具磨损是加工环境中意外停机的主要原因。刀具磨损具有间接和直接的负面影响。由于刀具故障导致的铣床停机时间占总停机时间的7%-20% 89,90,而刀具和刀具更换成本占总加工成本3%-12% 91。随着刀具状况的变化,检测刀具损伤的及时性非常重要,需要一种合适的刀具更换策略。一般来说,刀具更换策略是主观的和周期性的,而时间周期则取决于操作者的经验。可用刀具的早期更换会浪费刀具并增加停机时间,而磨损工具的过时更换则会导致工件质量降低和生产成本增加。因此,在铣削加工过程中,刀具状态监测(TCM)成为一个关键问题。

在刀具状态监测系统中,单一的传感器因其不确定性和局限性,无法达到良好的鲁棒性。由于电流、切削力、振动等多种测量传感器都能对测量信号进行处理,因此,利用多传感器方法可有效降低测量不确定度、提高测量数据丰富性、提高测量精度,因此对TCM多传感器的研究已成为一种趋势。文献92表明,在铣削加工系统中,多传感器方法被更频繁地使用。目前,一些研究发现,测量传感器的数量和特征参数与预测精度没有直接关系。特征提取的主要目的是从信号中提取特征参数,显著减小原始信息的大小。监测模型受特征提取的影响很大,一些特征参数的选取会大大增加模型的计算量。文献93,94表明,冗余和不相关的特性参数会对监控系统性能产生负面影响。目前,特征选择和特征融合是两种主要的多域特征提取方法。通过线性或非线性映射,利用特征融合的方法从预先设定的传感器特征参数集中提取新的参数,并利用新的特征作为监测模型的输入参数43,44,例如,在文献95中,特征参数降维,并利用局部保持投影(LPP)算法建立新的融合参数。此外,Wang等人96利用核主成分分析(PCA)算法对54个特征参数在频域和时域进行融合。然而,尽管特征融合方法具有提供更全面信息和降低特征维数的优点,但必须对所有传感器进行计算,并可能增加在线监测的维护成本,例如,97使用Pearson相关系数(PCC)从144个特征参数中选择了与刀具磨损值显著对应的13个参数。文献91利用快速相关滤波(FCBF)算法建立了包含19个特征参数的最小冗余特征,其频域、小波能量和时域参数总共为138个。特征选择方法不仅减少了输入参数的数目,而且减少了计算量。然而,这些方法主要考虑的是刀具状况与参数之间的关系,而不是对预测精度的影响。因此,获得最优的传感器特征参数组合是有效提高预测精度的关键。

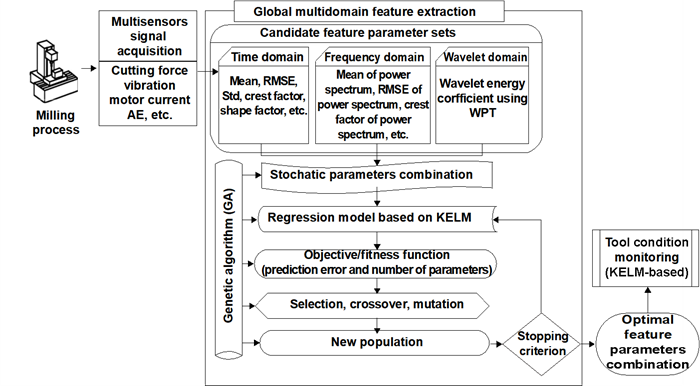

如图25所示,在98中介绍了一种多传感器融合方法。该方法的操作包括三个步骤:首先,采集动态信号来表征铣削过程;然后从多传感器中提取频率、时间和时频域的参数;最后,对刀具状况进行监测,并以传感器参数的最优组合为输入,利用核极值学习机(KELM)对刀具磨损量进行判断。

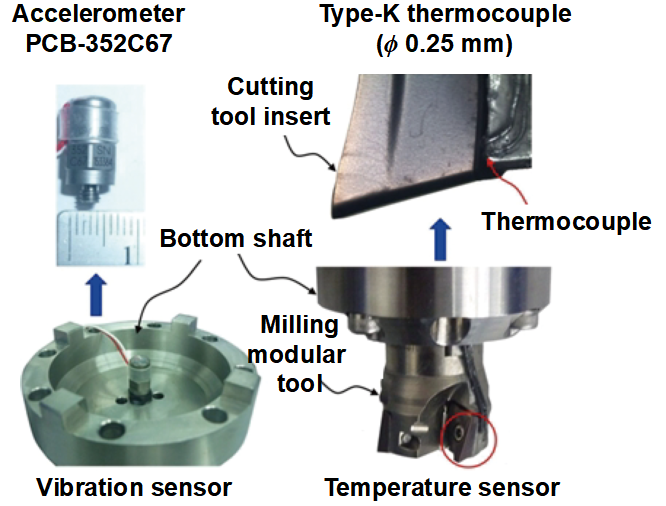

在99中,研究的重点是开发一种基于旋转刀具的多传感器测量系统,该系统可以在无线环境中同时测量切削力的振动、温度、扭矩和三个分量,如图26所示。同时,利用嵌入标准铣刀夹持器中的梁脚(Beam Leg)变换器产生切削力信号。在力传感器下方放置微型加速度计,而在切削刃附近放置热电偶,通过将感应无线发射器集成到标准旋转刀架中,可以获得所有信号并将其传输到数据记录系统。通过实验测试和验证,该多传感器系统测量机械信号是合适的、可靠的。

图25. 刀具状态监测方法示意图 AE:声发射;WPT:小波包变换;KELM:核极值学习机;RMSE:均方根误差98

图26. 振动和温度传感器的设置99

2.4 状态监测与故障检测系统

制造过程中,为了防止机器发生故障,可以通过不同类型的监测传感器进行故障检测和状态监测以延长机器寿命,降低运行成本,延长运行时间。最近,如100所述,红外热成像方法开始被提出和应用。此外,红外热成像可以实现非侵入、非接触和细粒度的温度测量,这对于机器状态监测和自动故障检测至关重要。红外热成像主要用于机器学习和图像处理,使系统能够自动检测运行情况和故障101-104。

有研究证明,可以利用红外热成像技术检测旋转机械中的一些故障和状况,如联轴器松动、不对中、转子不平衡、润滑剂不足和滚动轴承损坏104-107。在某些条件下,很容易理解为什么红外热成像有助于检测故障或状况,例如缺少润滑油,摩擦控制是润滑油的主要用途之一。轴承箱中润滑油过少会导致过度摩擦,从而产生红外摄像机能够检测到的热量;若轴承中的润滑油过多,则可能会发生搅动,并可能产生额外的热量。

从已有的振动分析技术中提取的特征可以用来弥补红外热成像方法的不足。因此,将这两种方法结合在一个多传感器系统中可以提高精度。在108中,振动数据和红外热成像数据用于提取特征和融合特征,融合特征随后提供给分类算法。

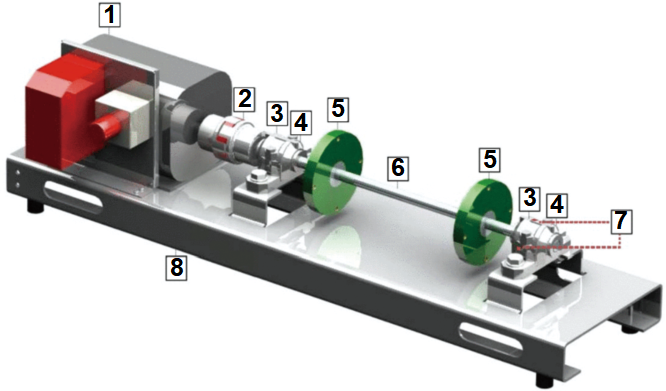

如图27所示,在测试过程中,右侧壳体中滚动轴承的设置发生了变化,因此这由热成像仪监控。除了红外摄像机外,还可以将热电偶放在室内测量环境温度。此外,轴承座上还安装了两个加速度计,用于测量x和y方向的加速度。结果表明,与单传感器相比,将这两类传感器数据结合起来则能更准确地检测出更多种情况或故障及其组合。

图27. 实验装置的三维显示。红外热像仪用来监视红场。1. 带速度控制器的伺服电机; 2.耦合;3.轴承箱;4.轴承;5.磁盘;6.轴;7.加速计;和8.金属板108

变压器是电力系统中的关键电气设备。因此,寻找变压器的潜在故障、研究变压器的故障诊断方法、提高电力系统的安全性是十分必要的。由于变压器结构的复杂性,其故障原因和现象具有多样性和随机性,所以必须采用有效的方法对变压器故障进行综合诊断。目前,变压器故障诊断方法主要有改进的三比值法、特征气体法、罗杰斯比法、模糊数学法、神经网络法等109。然而,这些方法在算法上仍有许多缺点,例如,精度不够高、需要大样本,因此有必要寻找一种有效的变压器故障诊断方法。在此基础上,研究110利用光电传感器和放电电路采集模块对变压器的故障进行综合诊断,即通过高精度的数据融合来诊断故障并确定故障位置,达到无人值守运行的目的。光电多传感器信息融合技术可以将多个传感器获取的信息进行组合、协调和补充,从而克服单个传感器的不确定性和局限性。

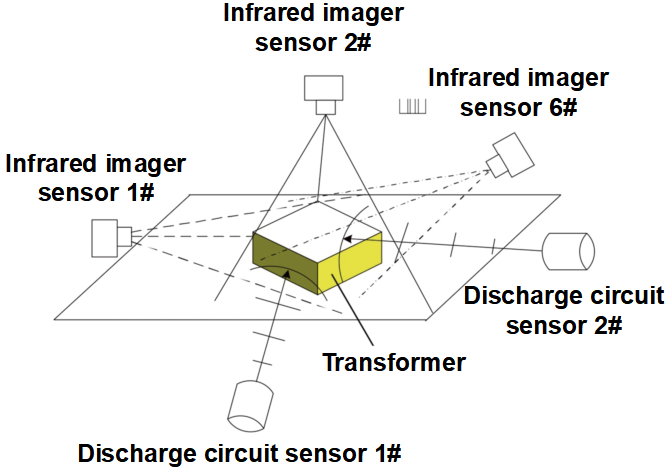

如图28所示,平台通过光电红外热成像传感器测量变压器内部温度来监测变压器故障。热红外成像传感器是一种光电转换装置,通常由铟锑或汞化合物制成,它用于接收红外辐射能量,并将其进一步转换成电信号,经过放大、重塑和模数转换成数字信号,最终将图像显示在监视器上。图像中每个点的灰度值与该点被检测对象的辐射能量相关。通过接收从被测物体表面发射的辐射,就可以方便地确定红外热传感器的温度111,112。

图28. 使用多传感器数据融合方法的诊断设置示意图110

3. 数据融合技术

数据融合是对多个传感器和信息源所提供的关于某一参数特征的不完整信息加以综合,以形成相对完整、一致的感知描述,从而实现更加准确的识别和判断功能113。数据融合过程是用数学方法和技术工具综合不同源信息,目的是得到高品质的有用信息。与单一信源独立处理相比,数据融合的优点包括:提高可探测性和可信度、扩大时空感知范围、降低推理模糊程度、改进探测精度等性能、增加目标特征维数、提高空间分辨率、增强系统容错能力等114。

近年来,多传感器数据融合技术无论在军事还是民事领域的应用都极为广泛。多传感器融合技术已成为军事、工业和高技术开发等多方面关心的问题115。这一技术广泛应用于C3I系统、复杂工业过程控制、机器人、自动目标识别、交通管制、惯性导航、海洋监视和管理、农业、遥感、医疗诊断、图像处理、模式识别等领域116。实践证明:与单传感器系统相比,运用多传感器数据融合技术在解决探测、跟踪和目标识别等问题方面,能够增强系统生存能力,提高整个系统的可靠性和鲁棒性,增强数据的可信度,并提高精度,扩展整个系统的时间、空间覆盖率,增加系统的实时性和信息利用率等117。

复杂工业过程控制是数据融合应用的一个重要领域。目前,数据融合技术已在核反应堆和石油平台监视等系统中得到应用。融合的目的是识别引起系统状态超出正常运行范围的故障条件,并据此触发若干报警器118。通过时间序列分析、频率分析、小波分析,从各传感器获取的信号模式中提取出特征数据;同时,将所提取的特征数据输入神经网络模式识别器,神经网络模式识别器进行特征级数据融合,以识别出系统的特征数据,并输入到模糊专家系统进行决策级融合114;专家系统推理时,从知识库和数据库中取出领域知识规则和参数,与特征数据进行匹配(融合);最后,决策出被测系统的运行状态、设备工作状况和故障等119。

3.1 数据融合层次

根据处理信息源的层次不同,信息融合可以分为数据层融合,特征层融合和决策层融合120。数据是指各传感器收集的测量数据,特征是经过分析和转换后的数据结果,决策是指观察目标的结论。具体如下所述。

1)数据层融合。数据层融合是原始数据的直接融合。它的输入由多个传感器提供的各种原始数据组成,其输出是特征提取或局部决策的结果。数据层融合的优点是可以从原始数据中提取更多细节121。 缺点包括繁重的计算负担,较差的实时性能以及需要良好的容错能力来处理传感器数据本身的不稳定性和不确定性,这仅适用于传感器的原始数据融合。方法主要包括加权平均法、选举决策法、卡尔曼滤波法、数理统计法122。

2)特征层融合。特征层融合是提取数据源的特征信息进行分析和处理,并保留重要信息为以后的决策分析提供支持123。特征层融合的优点是提取原始数据信息特征后,减少了要处理的数据量,提高了实时性能。方法主要包括卡尔曼滤波法、模糊推理法、神经网络法、 产生式规则法等。

3)决策层整合。决策级融合作为一种高级融合,具有较高的灵活性,较强的抗干扰能力,良好的容错能力和较小的通信带宽要求124。 首先,对传感器的测量数据进行预处理以获得对研究对象的初步判断。 然后,将所有决策结果按照特定规则进行融合,以获得最终的联合决策结果。因此,决策层融合需要压缩传感器的测量数据,这不仅会造成高昂的处理成本,而且导致大量细节的丢失。方法主要包括贝叶斯概率推理方法和Dempster-Shafer证据推理方法。

根据以上分析,三种不同级别的信息融合具有各自的优点,缺点和应用范围。无论采用哪种融合策略,都需要对相关信息进行处理和提取125。区别在于对数据的筛选手段不同。从理论上讲,数据层融合的优点是可以保留大量原始数据,以便为目标提供尽可能详细的信息,并获得尽可能准确的融合效果。要采用哪种融合策略,还应该考虑环境、计算能力、信息源特性和其他因素的综合影响126。

3.2 数据融合算法的分类

多源数据融合涉及到多方面的理论和技术,并没有完全统一的算法能够适应所有的场景,所以在应用上,需要针对不同的应用背景选择相应的算法。按算法概念分类,主要分成三大类,分别为:物理模型类、基于参数类和基于认知模型类127。

对于物理模型算法,此类算法是根据物理模型直接计算实体特征128。预测一个实体特征的物理模型必须以被识别物体的物理特征为基础,而实际物理模型往往相当复杂,建立起来非常困难。尽管实际中很少使用这种方法,但在基础研究工作中却需要使用。句法分析方法和估计理论法属于物理模型算法中的典型,句法分析方法开发了物理对象的语法和句法,而物理对象说明是分别从传感器数据分量获得的,因此能对来自这个假定的结构关系的一个对象的表示进行汇集。估计理论法包括卡尔曼滤波算法、最大似然估计法及最小二乘法等。

参数分类算法是最常见、应用最广、研究最深入的一类算法。此类算法寻求一个标识说明且使之依赖于参数数据,在参数数据和一个标识说明间建立一个直接的映像。此类算法可进一步分为基于统计的算法和基于信息论技术的算法129。

统计算法主要包括经典推理法、Bayes推理算法、基于D-S证据理论法等。经典推理:经典推理描述130 在给出目标存在的假设条件下,所观测到的数据与标识相关的概率。例如,设每种识别的目标类型是Ai,传感器是j。若有n个传感器对测量m种目标类型进行测量,则其测量模型可用正态分布表示为

P(xj|Ai)=1/(2π)1/2σij exp-(xj-μij)2/(2σij2) (1)

式中:xj为实际测量的观测值;μij、σij分别是目标Ai对传感器j的均值及均方差,可以通过历史数据经验获得。其局限性是仅能估计两个假设,即假设和与其相对的备择假设;当遇到多变量数据时,算法复杂性提高;需要一个先验密度函数的有效度,否则不能直接使用先验估计。

Bayes推理算法131解决了经典推理方法的某些困难。它以最小风险代价为基本模型,在给定一个预先似然估计和附加证据(观测)条件下,能更新一个假设的似然函数。首先,假设有n个传感器用来获取未知目标的参数数据。 每个传感器都基于传感器的观察结果和特定的传感器分类算法提供一个关于目标身份的描述。设O1,O2,O3...Om为所有可能的m个目标,Di表示第i个传感器对目标身份的描述,O1,O2,O3...Om实际上构成了观察空间的互不相容的穷举假设,则有

∑in=1P(Oi)=1 (2)

式中,P(Oi)为假设Oi为真的先验概率,且有

P(Oi|Di=(P(Di│Oi)P(Oi))/(∑(i=1)nP(Di│Oi)P(Oi))(i=1,2…n;j=1,2…,n) (3)

式中,P(Oi|Di)为给定证据Di的情况下,假设Oi为真的后验概率;P(Di|Oi)为Oi为真的情况下,证据Di的概率。

Bayes推理的缺点是:定义先验似然比较困难;当有多个可能的假设和多个条件相关时,显得很复杂;要求对立的假设彼此互不相容;缺乏分配总不确定性的能力。D-S证据理论132是Bayes理论的广义扩展,它考虑了总不确定性的程度。D-S方法利用了概率区间和不确定区间来确定多证据下假设的似然函数,当所有的假设互不相容且完备时,Bayes推理技术与D-S法产生相同的结果。

假设m1,m2,m3...mN是关于Ai(i=1,2,3...N)的分配函数,则D-S综合规则如下

式中K是冲突系数。

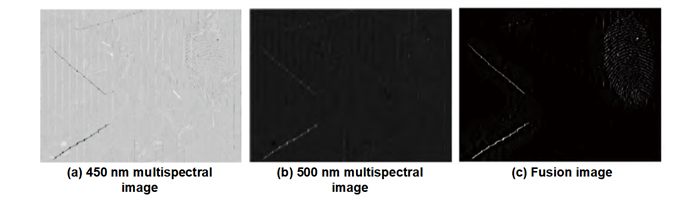

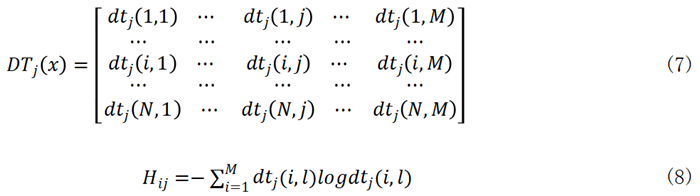

图29(a)和29(b)是由450 nm和500 nm的多光谱相机拍摄的太阳能电池表面缺陷的图像。用上述算法进行图像融合。结果示于图29(c)。该算法抑制了多晶硅太阳能电池复杂背景对表面缺陷提取的影响,提高了缺陷特性。通过融合多光谱图像,提高了缺陷部位的对比度,并且增强了太阳能电池上指纹和划痕的缺陷信息。

D-S法存在的问题包括:不能有效地处理矛盾的证据;具有幂指数增长的计算量;推理链较长时,使用证据理论很不方便;D-S组合规则具有组合灵敏性,但有时基本概率赋值一个很小的变化都可能导致结果很大的变化。

图29. 太阳能电池的缺陷图像融合133.

3.3 基于信息论的融合算法

在某些场合,多传感器数据融合目标识别并不需要用统计的方法直接模拟观测数据的随机形式,而是依赖于观测参数与目标身份之间的映射关系来对目标进行识别。这类方法称为基于信息论的融合识别算法,包括神经网络方法133,134,熵理论方法135和聚类算法136和表决法137。

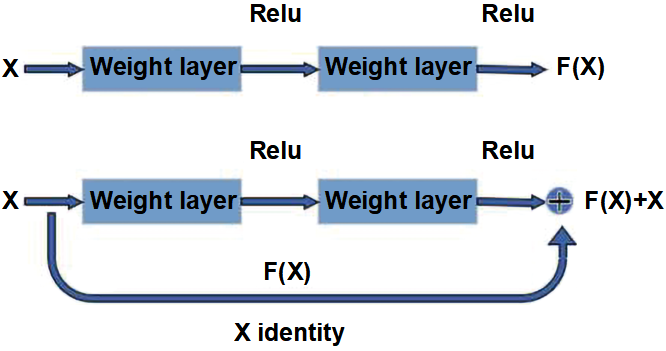

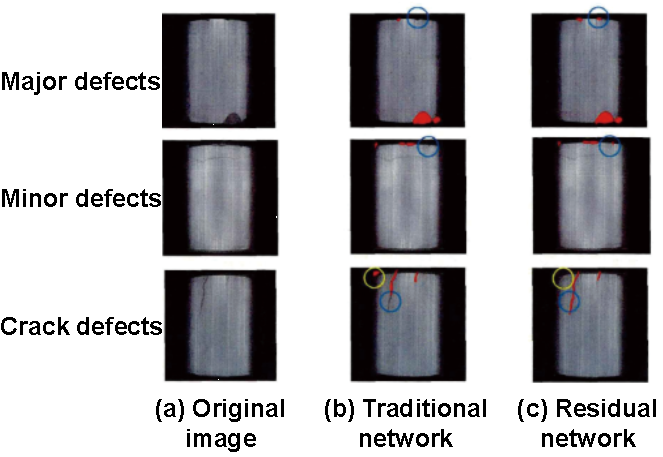

人工神经网络是在现代神经科学研究成果的基础上提出的。神经网络目标识别法是用非常简单的计算处理单元(神经元)进行互联构成的非线性网络系统,具有学习、记忆、计算能力以及各种智能识别处理能力,所有神经元可在没有外部同步信号作用的情况下执行大容量的并行计算。神经网络目标识别算法中最著名的是以自适应信号处理理论为基础发展起来的前向多层神经网络及其逆推学习(BP)算法。随着技术不断的发展,Kaiming He等人138提出了一种残差神经网络(ResNet),其主要表现为通过将浅层网络的输入和输出相加而得的特征图作为最终网络的输出。将这样的结构添加到网络中不仅可以增加网络的深度,还可以防止网络性能下降。从理论上讲,ResNet的出现极大地提高了可训练的神经网络的深度。网络性能的优化更加便捷。 ResNet结构如图30所示。

图30. 神经网络的传统结构和残差结构138.

从图30可以看出,该图将传统的训练方法与残差模型训练的网络进行了比较,残差模型可以更好地识别磁瓦表面上的缺陷区域,如图31中的蓝色圆圈所示。此外,改进的网络还可以修正磁瓦本身的纹理标记错误,如图31中的黄色圆圈所示。

图31. 两种检测磁瓦表面缺陷分割效果的神经网络方法138.

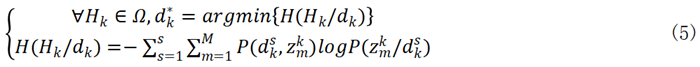

熵法是用于融合系统的一种新技术。利用了事件发生的概率,反映了信息量的思想。它的原理是经常发生的事情熵最小,而不经常发生的事情熵最大,将其用于传感器数据融合过程中,就是要作出使熵极高的结论。假定所有测量值概率P(dks)和特征值概率P(zmk)已知,并且条件概率分布P(dks/zmk)可以通过计算得到。 以下是根据最小条件熵的输入值提供的融合方法:

式中,Ω代表假设目标的集合,dk*代表满足最小条件熵标准测量值的集合,P(dks/zmk是测量值与目标假设之间的联合概率分布特征。在该标准下的融合系统可以获得最佳融合信息139。 熵法很有应用价值,尤其是对于实时性要求很高的系统,当准确的先验统计不可利用时,或者是从整个成本—效益观点来看,熵法都是很有吸引力的,国外已开始将熵法用于计算与假设有联系的信息内容的度量值。

所谓聚类就是把大量的d维数据样本聚集成n个类,使同一类内样本的相似性最大,而不同类内样本的相似性最小。聚类分析法是一种启发式算法,在模式类数目不是精确知道的标志性应用中,这类方法很有效,它是按某种聚类准则将数据分组(聚类),并把每个数据组解释为相应的目标类。聚类分析可以作为一个单独的工具以发现数据库中数据分布的一些深入的、隐含的、有用的信息,并且概括出每一类的特点,或者把注意力放在某一个特定的类上以作进一步的分析。例如,k均值聚类旨在将n个对象划分为k个聚类,其中每个对象均属于具有均值的聚类。该方法产生了, k个具有区别的不同簇。先验未知导致最大距离的最佳聚类数, k必须从数据中计算得到。k均值聚类的目的是使总簇内方差或平方误差函数最小化,如公式(6)所示。

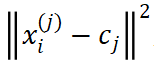

式中,J是目标函数,k是聚类数,n是目标点个数,xi(j)是i的现分布,cj是聚类j的质心,

是距离函数140。

是距离函数140。表决法类似于日常生活中的投票选举,它包括布尔“与”、“或”处理,是多传感器数据融合目标识别算法中最简单的技术。它由每个传感器提供对被测对象状态的一个判断,然后由表决算法对这些判断进行搜索,以找到一个由半数以上传感器“同意”的判断(或采取其他简单的判定规则),并宣布表决结果。也可采用加权方法、门限技术以及其他判定方法等,这种方法在没有准确的先验统计数据可利用时十分有用,特别是对于实时融合很有吸引力。

3.4 基于认知模型的融合算法

基于认识模型的算法主要包括逻辑模板法、模糊集理论算法、遗传算法及知识系统法等。

1)逻辑模板方法

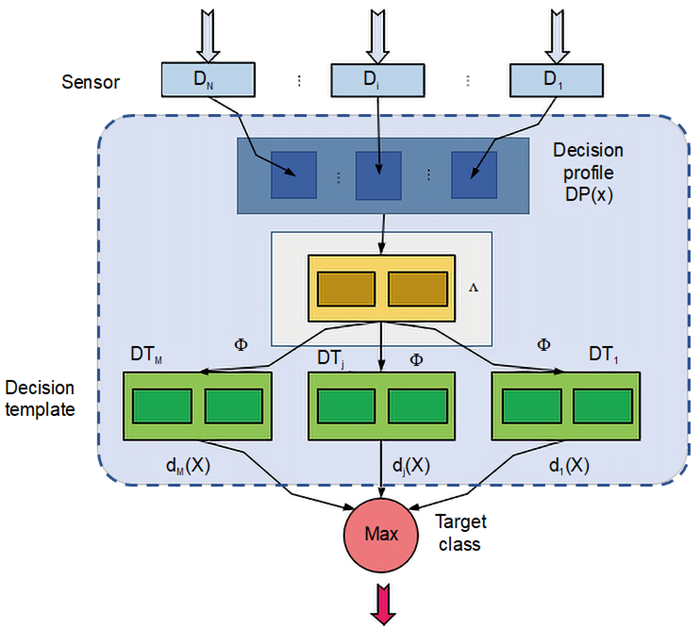

逻辑模板法实质上是一种匹配识别的方法,它将系统的一个预先确定的模式(模板)与观测数据进行匹配,确定条件是否满足,从而进行推理。预先确定的模式中可以包含逻辑条件、模糊概念、观测数据以及用来定义一个模式的逻辑关系中的不确定性等。因此模板实质上是一种表示与逻辑关系进行匹配的综合参数模式方法。决策模板法作为逻辑模板法的一类,是一种简单直观的决策层融合目标识别算法。经典的决策模板法没有充分利用各传感器对于不同类目标鉴别能力的先验信息。文献 141 提出利用传感器平均度量熵对决策模板法进行修正,合理度量多个传感器对不同类目标的分类鉴别能力,仿真结果表明改进的决策模板法能提高目标正确识别率。

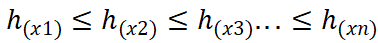

修改后的决策模板方法融合识别流程图如图32所示。虚线框中的部分在经典决策模板方法中不适用。 修改后的矩阵用于修改目标的决策分布图,以反映传感器分类识别特定目标的能力,从而获得修改后的目标决策分布图。选择最大相似度类别作为输出,对未知目标的决策分布图进行分类,从而实现融合目标的识别。

图32. 融合了识别框图的改进决策模板方法 141.

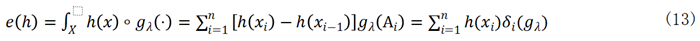

文献142针对经典的决策模板法不能反映传感器对目标的分类鉴别能力,不能适应待识别目标特征矢量起伏变化,同时没有保留训练样本全部信息等缺陷,提出了基于熵和K近邻方法的修正决策模板法,可以获取类别j的目标的决策模板公式:

Hi,j是第i个目标的第j个传感器的平均测量熵。调整每个局部传感器的权重,优化目标是使Hi,j,i∈S的平方和最小。最小化问题描述如下:

然后以矩阵形式写出加权值

:

:

Λ称为校正矩阵。对于识别出的目标,根据每个传感器输出的识别结果,获得目标x的决策分布图DP(x)。 因此,可以在公式(11)中获得目标的修改后的决策轮廓,从而使得多传感器融合目标识别的性能得到很大的改善。

图33是钛合金边缘腐蚀效应的图像融合结果,通过多传感器融合目标识别效果得到极大提升。

图33. 钛合金边缘腐蚀效应的图像融合结果142.

2)模糊集理论算法。

由于环境的复杂性、噪声干扰、识别系统的不稳定及采用不同识别算法等因素的影响,目标信号以及提取的特征参量信息存在不精确、不完整和不可靠性。此外,进行目标识别的判决方法上也存在一定的主观模糊性。模糊集理论是解决这类问题的强有力数学工具。模糊集理论中丰富的融合算子和决策规则为有效进行目标融合处理提供了必要的手段。近年来,国内外一些学者已开始将模糊集理论应用于目标身份确认问题。如 Kemley 143基于电子侦察数据,使用模糊逻辑融合多传感器数据进行目标身份确认。Roux等人144 基于模糊集的可能性理论,进行多谱卫星图像融合以解决图像分类问题。

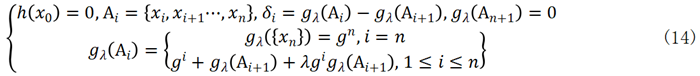

文献145 通过运用模糊集理论中的模糊综合函数,建立了多传感器目标识别决策级融合模型。 根据每个传感器在k累积的目标识别的概率分布,通过模糊综合函数对M个传感器的概率分布进行融合;到k为止,传感器系统累积的目标识别和融合的概率分布可以得出:

式中SM:?0,1M→0,1表示模糊综合函数。通过概率分布描述传感器目标识别的结果,实现了基于模糊综合函数的目标识别与融合算法。

文献146将模糊测度和模糊积分引入到多传感器数据融合目标识别中。给出了模糊积分应用于决策层数据融合目标识别的一般技术路线,并提供了信息源重要程度的度量方法。

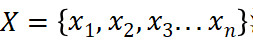

对于有限离散集

满足条件:

满足条件: ,模糊积分公式如下。

,模糊积分公式如下。

式中

hxi应用于信息融合目标识别,表示xi提供的目标判断结果。 gλ(xi)表示xi的重要过程。

hxi应用于信息融合目标识别,表示xi提供的目标判断结果。 gλ(xi)表示xi的重要过程。

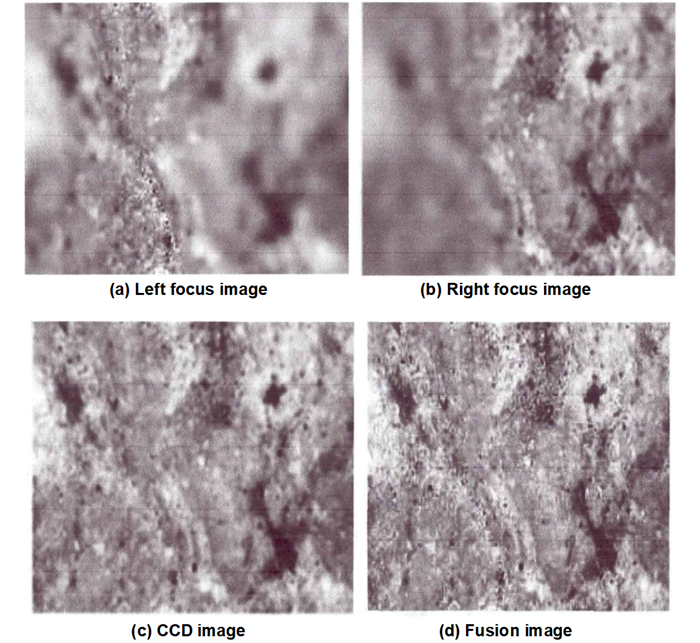

文献147 给出了一种多源多层次自适应变权重的多传感器目标融合的模糊算法,提供了一种表达和处理不确定性信息的有效方法,充分利用了各传感器信息源之间的冗余性和互补性以及各信息源自身的可靠性信息,达到了较好的识别效果。图34(a)和34(b)是通过调整显微镜透镜的焦平面拍摄的石材表面的显微图像,而图34(c)是电荷耦合器件(CCD)相机拍摄的石材表面图像。用上述算法进行图像融合,结果如图34(d)所示。该算法用于实现微观图像融合,并获得近似的全聚焦图像。可以有效地解决图像传感器的景深限制,并可以获得被测物表面准确完整的特征信息。不同类型传感器在相同的工作环境下具有不同的识别能力,模糊集理论算法考虑了信源的重要程度,反应了客观实际,融合识别结果优于D-S证据理论,并且相对于D-S证据理论,模糊积分中不涉及识别框架的论域问题,有利于增大识别框架,提高融合系统的实用性。

图34. 石材板材表面形态的图像融合结果147.

3)遗传算法

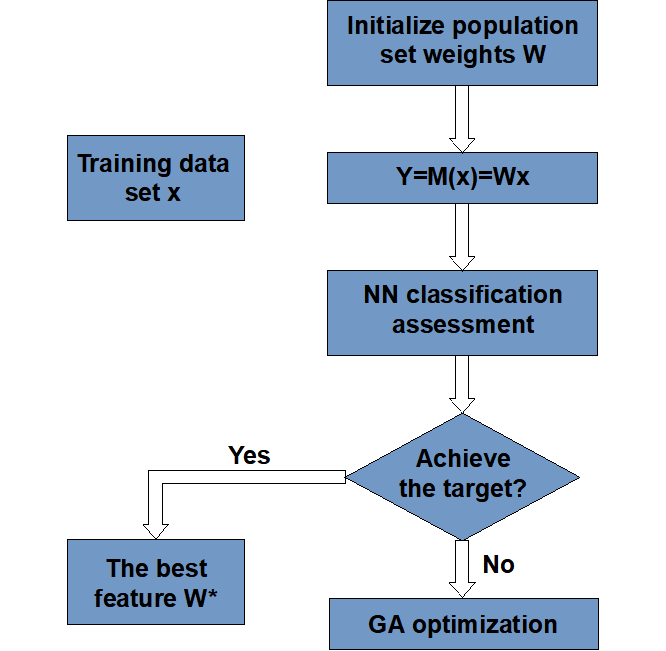

遗传算法是一个群体优化过程,它由一组初始值出发进行优化,优化过程就是这个群体不断繁衍、竞争和遗传、变异的过程148。文献149将遗传算法与神经网络目标分类器结合,如图35所示,通过识别结果的反馈信息,控制遗传算法的遗传进化方向实现特征优化,为克服遗传算法的未成熟收敛问题,提出了相关选择与自适应遗传算子相结合的改进遗传算法,实验结果验证了方法的有效性。

图35. 基于遗传算法的特征优化方法149.

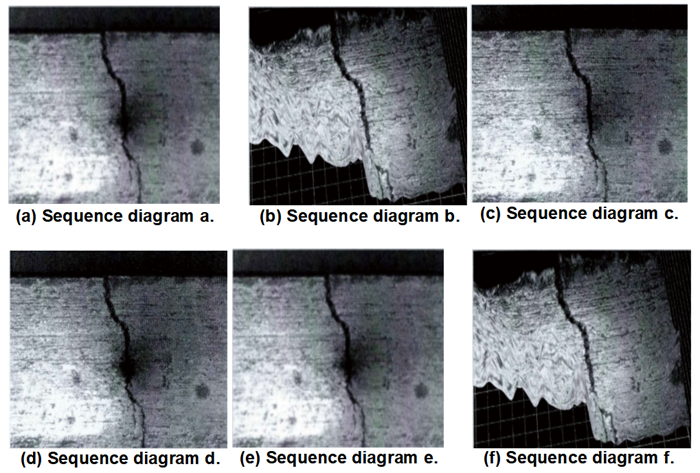

图36(a)-(d)是通过调节显微镜透镜的焦平面拍摄的钢板表面裂纹的显微图像,结果如图36(e)所示。该算法用于实现显微图像融合,并获得近似全焦点图像。它可以清晰地反映样品表面信息,消除了景深的影响。然后,可以通过图像的焦距获得深度信息,并且可以实现二维图像的三维重构,继而可以测量工件裂纹的长度,宽度和深度信息。

图36. 钢板表面裂纹的图像融合结果150.

4)知识体系方法。

知识是对某些客观对象的认识,并通过属性来标注这种认识。如果能够给出某个对象集合的属性特征,则该对象集合表达了一种完全知识151。文献152以PSM和本体为核心,构筑了知识系统建模框架,将应用领域知识系统结构要素分为需求本体、概念本体、方法本体、控制知识和解释知识。文献153还将概念本体和方法本体融入多主体建模中,探讨了知识本体维护和管理机制及系统结构,为知识系统建模集成探索了一条有效的途径,也为基于知识系统的多传感器数据融合目标识别算法研究提供了清晰有效的思路。

4.展望

目前,多功能传感器已成为新兴的研究领域。研究人员正尝试设计一个能够提供多种测量结果的多功能传感器的单个单元。尽管具有可靠性问题,多功能传感器的利用依然大有裨益,因为它可以占用更少的空间并降低成本。多功能传感器已越来越多地用于环境,生物医学,机械,电场等领域,在材料科学以及电气工程领域的多功能传感器中亦已经进行了一些重要的工作。

数据融合技术方兴未艾,几乎一切信息处理方法都可以应用于数据融合系统。随着传感器、数据处理、计算机、网络通讯、人工智能、并行计算软件和硬件等相关技术的发展,尤其是人工智能技术的进步,新的、更有效的数据融合方法将不断推出,多传感器数据融合必将成为未来复杂工业系统智能检测与数据处理的重要技术,其应用领域将不断扩大。多传感器数据融合不是一门单一的技术,而是一门跨学科的综合理论和方法,是一个逐步走向成熟的新兴研究领域,尚处在不断变化和发展过程中。

但是,目前尚未建立统一的融合理论和有效广义融合模型及算法;对数据融合的具体方法的研究尚处于初步阶段;还没有很好解决融合系统中的容错性或鲁棒性问题;关联的二义性是数据融合中的主要障碍;数据融合系统的设计还存在许多实际问题。为了确保多传感器过程监控系统的可靠性和保证数据融合的结果,应该建立统一的融合理论、数据融合的体系结构和广义融合模型;解决数据配准、数据预处理、数据库构建、数据库管理、人机接口、通用软件包开发问题,利用成熟的辅助技术,建立面向具体应用需求的数据融合系统;将人工智能技术,如神经网络、遗传算法、模糊理论、专家理论等引入到数据融合领域;利用集成的智能计算方法(如,模糊逻辑+神经网络,遗传算法+模糊+神经网络等)提高多传感融合的性能;不确定性因素的表达和推理演算,例如:引入灰数的概念;有关的先验数据提高数据融合的性能,研究更加先进复杂的融合算法(未知和动态环境中,采用并行计算机结构多传感器集成与融合方法的研究等);在多平台/单平台、异类/同类多传感器的应用背景下,建立计算复杂程度低,同时又能满足任务要求的数据处理模型和算法;构建数据融合测试评估平台和多传感器管理体系;将已有的融合方法工程化与商品化,开发能够提供多种复杂融合算法的处理硬件,以便在数据获取的同时就实时地完成融合。

随着研究者的不断努力,不久的将来,数据融合的基础理论、兼有鲁棒性和准确性的融合算法将不断地得到完善,实现技术将不断地得到更新,实际应用将不断被扩展,多传感器数据融合技术必将不断地走向成熟。

5.结论

本文综述了多传感器过程监测系统和数据融合技术。一般情况下,单个传感器只能获取部分测量信息。集成与融合的多传感器系统的信息具有丰富、互补、实时、低成本的特点。多传感器信息融合技术在工业机器人、航空航天、军事、多目标跟踪、数控技术、智能制造等领域具有广阔的应用前景。介绍了多传感器系统在不同研究领域的一些应用。此外,随着传感器、大数据和云处理、计算机软硬件、人工智能等现代技术的发展,多传感器数据融合和目标识别将成为未来目标识别研究的重点。在介绍多源数据融合目标识别原理及其算法理论基础的前提下,从算法概念分类的角度,对多源数据融合目标识别算法进行了详细总结,为下一步多传感器数据融合目标识别研究提供了一定的理论依据。

致谢

研究得到上海市科技创新行动计划项目(19ZR1404600, 17JC1400601), 国家重点研发项目(2017YFA0701200, 2016YFF0102003), 以及科学挑战计划项目(JCKY2016212A506-0106)的资助.

参考文献

1 K.T. Chung, A. Geddam. A multi-sensor approach to the monitoring of end milling operations. Journal of Materials Processing Technology, 2003, 139: 15-20.

2 J.V. Abellan-Nebot, F.R. Subirón. A review of machining monitoring systems based on artificial intelligence process models. Int. J. Adv. Manuf. Technol., 2010, 47: 237–257.

3 S.Y. Liang, R.L. Hecker, R.G. Landers. Machining process monitoring and control: the state-of-the-art. J. Manuf. Sci. Eng., 2004, 126: 297–310.

4 J. A. Duro, J. A. Padget, C. R. Bowen, H. A. Kim, A. Nassehi. Multi-sensor data fusion framework for CNC machining monitoring. Mechanical Systems and Signal Processing, 2016, 66: 505-520.

5 J. K. Hackett and M. Shah. Multi-sensor fusion: A perspective. Proceedings, International Conference on Robotics and Automation, 1990, 1324-1330.

6 R. Joshi, A. C. Sanderson. Multisensor fusion: A minimal representation framework. World Scientific, 1999.

7 H. B. Mitchell. Multi-sensor data fusion: An introduction. Springer, 2007.

8 B. Khaleghi, A. Khamis, F. O. Karray, S. N. Razavi. Multi-sensor data fusion: A review of the state-of-the-art. Information Fusion, 2013, 14: 28-44.

9 R. C. Luo, C. C. Chang, C. C. Lai. Multi-sensor fusion and integration: Theories, applications, and its perspectives. IEEE Sensors Journal, 2011, 11: 3122-3138.

10 D. Smith, S. Singh. Approaches to multi-sensor data fusion in target tracking: A survey. IEEE Transactions on Knowledge and Data Engineering, 2006, 18: 1696-1710.

11 S. Lynen, M. W. Achtelik, S. Weiss, M. Chli, R. Siegwart. A robust and modular multi-sensor fusion approach applied to mav navigation. International Conference on Intelligent Robots and Systems (IROS), 2013, 3923-3929.

12 B. D. Majumder, J. K. Roy, S. Padhee. Recent Advances in Multifunctional SensingTechnology on a Perspective of Multi-Sensor System: A Review. IEEE SENSORS JOURNAL, 2019, 19: 1204-1214.

13 W. A. Abdulhafiz, A. Khamis. Bayesian approach to multi-sensor data fusion with pre-and post-filtering. 10th IEEE International Conference on Networking, Sensing and Control, 2013, 373-378.

14 R. C. Luo, C. C. Chang. Multisensor Fusion and Integration: A Review on Approaches and Its Applications in Mechatronics. IEEE TRANSACTIONS ON INDUSTRIAL INFORMATICS, 2012, 8: 49-60.

15 W. Elmenreich. A review on system architectures for sensor fusion applications. Proc. Int. Federat. Inf. Process., 2007, 547–559.

16 R. C. Luo, K. L. Su. Multilevel multi sensory-based intelligent recharging system for mobile robot. IEEE Trans. Ind. Electron., 2008, 55: 270–279.

17 S. Matzka, R. Altendorfer. A comparison of track-to-track fusion algorithms for automotive sensor fusion. Proc. IEEE Int. Conf. Mul-tisensor Fusion Integrat. Intell. Syst., 2008, 189–194.

18 Y. Yang, C. Han, X. Kang, D. Han. An overview on pixel-level image fusion in remote sensing. Proc. IEEE Int. Conf. Autom. Lo-gist., 2007, 2339–2344.

19 L. Zhang, J. Stiens, H. Sahli. Multispectral image fusion for active millimeter wave imaging application. Proc. Global Symp. Mil-limeter Waves, 2008, 131–134.

20 R. C. Luo, K. L. Su. A review of high-level multisensor fusion: Approaches and applications. Proc. IEEE Int. Conf. Multisensor Fusion Integrat. Intell. Syst., 1999, 25–31.

21 M. Liggins, D. Hall, J. Llinas, in: Handbook of Multisensor Data Fusion: Theory and Practice, second ed., CRC Press, Boca Raton, FL, 2009, pp. 32742–33487. 3 B. Khaleghi,

22 H. Hashmipour, S. Roy, A. Laub. Decentralized structures for parallel Kalman Filtering. IEEE Trans. Autom. Control, 1988, 33: 88–93.

23 Y. Zhu, Z. You, J. Zhao, K. Zhang, X. Li. The optimality for the distributed Kalman filtering fusion with feedback, Automatica, 2001, 37: 1489–1493.

24 S. Sun, Z. Deng. Multi-sensor optimal information fusion Kalman filter. Automatica, 2004, 40: 1017–1023.

25 K. Chang, Z. Tian, S. Mori, C. Chong. Performance evaluation for MAP state estimate fusion. IEEE Trans. Aerosp. Electron. Syst., 2004, 40: 706–714.

26 S. Sun. Multi-sensor information fusion white noise filter weighted by scalars based on Kalman predictor. Automatica, 2004, 40: 1447–1453.

27 E. Song, Y. Zhu, J. Zhou, Z. You. Optimal Kalman filtering fusion with cross–correlated sensor noises. Automatica, 2007, 43: 1450–1456.

28 X. Li, Y. Zhu, J. Wang, C. Han. Optimal linear estimation fusion—Part I: Unified fusion rules, IEEE Trans. Inf. Theory, 2003, 49: 2192–2208.

29 A. Khamis, F. Karray, S. Razavi. Multisensor data fusion: a review of the state-of-the-art. Inf. Fusion, 2013, 14: 28–44.

30 S. Sun. Distributed optimal component fusion weighted by scalars for fixed-lag Kalman smoother. Automatica, 2005, 41: 2153–2159.

31 J. Feng, M. Zeng. Optimal distributed Kalman filtering fusion for a linear dynamic system with cross-correlated noises. Int. J. Syst. Sci. 2012, 43: 385–398.

32 K. Kim. Development of track to track fusion algorithm. Proceeding of the American control conference, 1994, 1037–1041.

33 X. Li, Y. Zhu, J. Wang, C. Han. Unified optimal linear estimation fusion Part I: unified models and fusion rules. Information Fusion Conference, 2000, 10–17.

34 S. Sun. Multi-sensor optimal information fusion Kalman filter with application, Aerosp. Sci. Technol., 2004, 8: 57–62.

35 S. K. Moon, Y. E. Tan, J. Hwang, Y. J. Yoon. Application of 3D Printing Technology for Designing Light-Weight Unmanned Aerial Vehicle Wing Structures. Int. J. Precis. Eng. Manuf.-Green Tech., 2014, 1: 223-228.

36 W. E. Frazier. Metal Additive Manufacturing: A Review. Journal of Materials Engineering and Performance, 2014, 23: 1917-1928.

37 X. Yao, S. K. Moon, G. Bi. A Cost-Driven Design Methodology for Additive Manufactured Variable Platforms in Product Families. Journal of Mechanical Design, 2016, 138: 041701.

38 X. Peng, L. B. Kong, Y. Chen, J. H. Wang, M. Xu. A preliminary study of in-situ defects measurement for additive manufacturing based on muti-spectrum. 9th International Symposium on Advanced Optical Manufacturing and Testing Technologies: Sub diffraction-limited Plasmonic Lithography and Innovative Manufacturing Technology, 2018, 1084217.

39 H. Ko, S. K. Moon, J. Hwang. Design for Additive Manufacturing in Customized Products. Int. J. Precis. Eng. Manuf., 2015, 16: 2369-2375.

40 P. Lott, H. Schleifenbaum, W. Meiners, K. Wissenbach, C. Hinke, J. Bultmann. Design of an optical system for the in situ process monitoring of selective laser melting. Physics Procedia, 2011, 12: 683-690.

41 M. Doubenskaia, M. Pavlov, S. Grigoriev, E. Tikhonova, I. Smurov. Comprehensive Optical Monitoring of Selective Laser Melting. Journal of Laser Micro/Nanoengineering, 2012, 7: 236-243.

42 J. Schilp, C. Seidel, H. Krauss, J. Weirather. Investigation on Temperature Fields during Laser Beam Melting by Means of Process Monitoring and Multiscale Process Modelling. Advances in Mechanical Engineering, 2014, 217584.

43 G. Marco, M. C. Bianca. Process defects and in situ monitoring methods in metal powder bed fusion: a review. Measurement Science and Technology, 2017, 25: 044005.

44 T. Craeghs, F. Bechmann, S. Berumen, J. P. Kruth. Feedback control of Layerwise Laser Melting using optical sensors. Physics Procedia, 2010, 5: 505-514.

45 J. Mireles, S. Ridwan, P. A. Morton, A. Hinojos, R. B. Wicker. Analysis and correction of defects within parts fabricated using powder bed fusion technology. Surface Topography: Metrology and Properties, 2015, 3, 034002.

46 A. Standard. Standard Terminology for Additive Manufacturing Technologies. ASTM International, 2012, F2792-12a.

47 J. P. Kruth, P. Mercelis, J. V. Van, T. Craeghs. Feedback control of selective laser melting. Proc. of the 3rd Int. Conf. on Advanced Research in Virtual and Rapid Prototyping, 2007, 521–527.

48 S. Berumen, F. Bechmann, S. Lindner, J. P. Kruth, T. Craeghs. Quality control of laser and powder bed-based Additive Manufacturing (AM) technologies. Phys. Proc., 2010, 5: 617-622.

49 T. Craeghs, S. Clijsters, J. P. Kruth, F. Bechmann, M. C. Ebert. Detection of process failures in layerwise laser melting with optical process monitoring. Phys. Proc., 2012, 39: 753-759.

50 S. Clijsters, T. Craeghs, S. Buls, K. Kempen, J. P. Kruth. In situ quality control of the selective laser melting process using a high-speed, real-time melt pool monitoring system. Int. J. Adv. Manuf. Technol., 2014, 75: 1089-1101.

51 T. Petrat, B. Graf, A. Gumenyuk, M. Rethmeier. Laser Metal Deposition as Repair Technology for a Gas Turbine Burner Made of Inconel 718. Physics Procedia, 2016, 83: 761-768.

52 Y. C. Zhang, H. A. II, K. M. Seung. Process Monitoring and Inspection Systems in Metal Additive Manufacturing: Status and Applications. International Journal of Precision Engineering and Manufacturing-Green Technology, 2017, 4: 235-245.

53 D. Hu, R. Kovacevic. Sensing, Modeling and Control for Laser-Based Additive Manufacturing. International Journal of Machine Tools and Manufacture, 2003, 43: 51-60.

54 M. Chabot, J. Y. Rauch. Hascoet. Towards a multi-sensor monitoring methodology for AM metallic processes. Welding in the word, 2019, 63: 759-769.

55 J. Xiong, YP Pi, H Chen. Deposition detection and feature point extraction in robolic GTA-based additive manufacturing using passive vision sensing. Robotics and Computer Intergrated Manufacturing, 2019, 59: 326-334.

56 J. Xiong, G.C. Liu, Y.P. Pi. Increasing stability in robotic GTA-based additive manufacturing through optical measurement and feedback control. Robotics and Computer Integrated Manufacturing, 2019, 59:385-393.

57 A. Vandone, S. Baraldo, A. Valente. Multisensor Data Fusion for Additive Manufacturing Process Control. IEEE ROBOTICS AND AUTOMATION LETTERS, 2018,3: 3279-3284.

58 M. S. Hossain, J. Mireles, P. Morton, Y. Lin, C. A. Terrazas, R. B. Wicker. Part re-registration during process interruption of electron beam melting additive manufacturing. The International Journal of Advanced Manufacturing Technology, 2018, 96: 337-344.

59 J. Shao, Y. Yan. Review of techniques for online monitoring and inspection of laser welding. J. Phys.: Conf. Ser. 2005, 15: 101-107.

60 Y. Kawahito, N. Matsumoto, M. Mizutani, S. Katayama. Characterisation of plasma induced during high power fibre laser welding of stainless steel. Sci. Technol. Weld. Joining, 2008, 13: 744-748.

61 A. Ostendorf, C. J. Kulik, M. Stallmach, J. Zeadan. Basic investigations for controlling the laser spot-welding process when packaging 3-dimensional molded interconnect devices. Photon Process. Microelectron.Photonics III, 2004, 5339: 441-447.

62 X. Zhang, W. Chen, E. Ashida, F. Matsuda. Relationship between weld quality and optical emissions in underwater Nd:YAG laser welding. Opt. Lasers Eng., 2004, 41: 717-730.

63 S. Palanco, M. Klassen, J. Skupin, K. Hansen, E. Schubert, G. Sepold, J. J. Laserna. Spectroscopic diagnostics on CW-laser welding plasmas of aluminum alloys. Spectrochim. Acta Part B, 2001, 56: 651–659.

64 P. D. Bono, C. Allen, G. Angelo, A. Cisi. Investigation of optical sensor approaches for real-time monitoring during fibre laser welding. Journal of Laser Application, 2017, 29: 022417.

65 D. Y. You, X. D. Gao, S. Katayama. Review of laser welding monitoring. Science and Technology of Welding and Joining, 2014, 19: 181-201.

66 Y. M. Zhang, S. B. Zhang, Y. C. Liu. A plasma cloud charge sensor for pulse keyhole process control, Measurement Science Technology, 2001, 12: 1365-1370.

67 L. Li, D. J. Brookfield, K. Williams, W. M. Steen, H. B. Chen. Laser process monitoring with dual wavelength optical sensors. Proc. of the Laser Materials Processing Symposium ICALEO'91, San Jose, California, USA 1991: 113-122.

68 I. Miyamoto, K. Kamimuki, H. Maruo, K. Mori, M. Sakamoto. In-process monitoring in laser welding of auto-motive parts, Proc. of ICALEO'93, 1993, 413-424.

69 I. Miyamoto, K. Mori. Development of in-process monitoring system for laser welding, Proc. of ICALEO’95,1995, 759-767.

70 R. Olsson, I. Eriksson, J. Powell, A. V. Langtry, A. F. H. Kaplan. Challenges to the interpretation of the electro-magnetic feedback from laser welding. Optics and Lasers in Engineering, 2011, 49: 188-194.

71 H. Park and S. Rhee. Development of a weld quality monitoring system in CO2 laser welding by using photodiode. Journal of Laser Applications, 2001,13: 12-18.

72 Y. W. Park, H. Park, S. Rhee, M. Kang. Real time estimation of CO2 laser weld quality for automotive industry, Optics and Laser Technology, 2002, 34: 135-142.

73 T. Sibillano, A. Ancona, V. Berardi, P. M. Lugara. Real-time monitoring of laser welding by correlation analysis: the case of AA5083. Optics and Lasers in Engineering, 2007, 45: 1005-1009.

74 S. Palanco, M. Klassen, J. Skupin, K. Hansen, E. Schu-bert, G. Sepold, J. J. Laserna, Spectroscopic diagnostics on CW-laser welding plasmas of aluminum alloys, Spectrochimica Acta Part B: Atomic Spectroscopy, 2001, 56: 641-659.

75 J. M. Jauregui, B. J. Aalderink, R. G. K. M. Aarts, J. Olde Benneker, J. Meijer, Design, implementation and testing of a fuzzy control scheme for laser welding, Journal of Laser Applications, 2008, 20: 146-153.

76 J. Yu, Y. Sohn, Y. W. Park, J. S. Kwak. The development of a quality prediction system for aluminum laser welding to measure plasma intensity using photodiodes. Journal of Mechanical Science and Technology, 2016, 30: 4697-4704.

77 S. Nagarajan, P. Banerjee, W.H. Chen. Control of the welding process using infrared sensors. IEEE Trans Robot Autom, 1992, 8:86-93.

78 N. M. Carlson, J. A. Johnson. Ultrasonic sensing of weld pool penetration. Weld J (Miami; USA),1988, 67.

79 X. W. Wang. Three-dimensional vision applications in GTAW process modeling and control. Int J Adv Manuf Technol, 2015, 80:1601-11.

80 W. J. Zhang, Y. K. Liu, Wang X, et al. Characterization of three dimensional weld pool surface in GTAW. Weld J, 2012, 91:195-203.

81 R. Liang, R. Yu, Y. Luo, Y. M. Zhang. Machine learning of weld joint penetration from weld pool surface usingsupport vector regression. J.Phys. Journal of Manufacturing Processes. 2019, 41: 23-28.

82 Y. Kawahito, T. Ohnishi, S. Katayama. In-process monitoring and feedback control for stable production of full-penetration weld in continuous wave fiber laser welding, J. Phys. D Appl. Phys. 2009, 42: 85501–85508.

83 L. Wang, X. D. Gao, Z. Q. Chen. Status analysis of keyhole bottom in laser-MAG hybrid welding process. Opt. Exp. 2018, 26: 347-355.

84 X. D. Gao, D. Y. You, S. Katayama. The high frequency characteristics of laser reflection and visible light during solid state disk laser welding. Laser Phys. Lett. 2015, 12: 076003.

85 Y. Zhang, C. Zhang, L. Tan, S. Li. Coaxial monitoring of the fibre laser lap welding of Zn-coated steel sheets using an auxiliary illuminant. Opt. Laser Technol. 2013, 50: 167-175.

86 D.Y. You, X.D. Gao, S. Katayama, Detection of imperfection formation in disk laser welding using multiple on-line measurements, J. Mater. Process. Technol.,2015, 219: 209–220.

87 X. D. Gao, Z. M. Lia, W. Lin, X. H. Zhou, D. Y. Youa, P. P. Gao. Detection of weld imperfection in high-power disk laser welding based on association analysis of multi-sensing features. Optics and Laser Technology, 2019, 115: 306-315.

88 K. Javed, R. Gouriveau, X. Li, N. Zerhouni. Tool wear monitoring and prognostics challenges: A comparison of connectionist methods toward an adaptive ensemble model. J. Intell. Manuf. 2016, 1-18.

89 G. Vetrichelvan, S. Sundaram, S.S. Kumaran, P. Velmurugan. An investigation of tool wear using a coustic emission and genetic algorithm. J. Vib. Control 2014, 21: 3061-3066.

90 P. Bhattacharyya, D. Sengupta, S. Mukhopadhyay. Cutting force-based real-time estimation of tool wear in face milling using a combination of signal processing techniques. Mech. Syst. Signal Process. 2007, 21: 2665-2683.

91 C. Liu, G. F. Wang, Z. M. Li. Incremental learning for online tool condition monitoring using ellipsoid artmap network model. Appl. Soft Comput. 2015, 35: 186–198.

92 Y. Q. Zhou, W. Xue. Review of tool condition monitoring methods in milling processes. Int. J. Adv. Manuf. Technol. 2018, 96: 2509-2523.

93 C. Zhang, X. Yao, J. Zhang, H. Jin. Tool condition monitoring and remaining useful life prognostic based on a wireless sensor in dry milling operations. Sensors, 2016, 16: 795.

94 M. Grasso, P. Albertelli, B. M. Colosimo. An Adaptive SPC Approach for Multi-sensor Fusion and Monitoring of Time-varying Processes. Procedia Cirp 2013, 12: 61-66.

95 G. Wang, Y. Zhang, C. Liu, Q. Xie, Y. Xu. A new tool wear monitoring method based on multi-scale pca. J. Intell. Manuf. 2016, 7: 1-10.

96 G. F.Wang, Y. W. Yang, Y. C. Zhang, Q. L. Xie. Vibration sensor based tool condition monitoring using ν, support vector machine and locality preserving projection. Sens. Actuators A Phys. 2014, 209: 24-32.

97 J. Wang, J. Xie, R. Zhao, L. Zhang, L. Duan. Multi sensory fusion based virtual tool wear sensing for ubiquitous manufacturing. Robot. Comput. Integr. Manuf. 2017, 45: 47-58.

98 Y. Q. Zhou, W. Xue. A Multisensor Fusion Method for Tool ConditionMonitoring in Milling. Sensors 2018, 18: 3866.

99 R. Muhammad, A. G. Jaharah, Z. N. Mohd, H. C. H. Che. An embedded multi-sensor system on the rotating dynamometerfor real-time condition monitoring in milling. Int. J. Adv. Manuf. Technol., 2018, 95: 811-823.

100 T. Touret, C. Changenet, F. Ville, M. Lalmi, S. Becquerelle. On the use of temperature for online condition monitoring of geared systems-A review. Mech. Syst. Signal Process., 2018, 101: 197-210.

101 A. Widodo, D. Satrijo, T. Prahasto, G. M. Lim, and B. K. Choi. Confirmation of thermal images and vibration signals for intelligent machine fault diagnostics. Int. J. Rotating Mach., 2012, 1-10.

102 V. T. Tran, B. S. Yang, F. Gu, A. Ball.Thermal image enhancement using bi-dimensional empirical mode decomposition in combination with relevance vector machine for rotating machinery fault diagnosis. Mech.Syst. Signal Process., 2013, 38: 601-614.

103 A. Younus and B. Yang. Wavelet coefficient of thermal image analysis for machine fault diagnosis. Proc. Int. Conf. Mech. Eng., 2009,1-7.

104 O. Janssens. Convolutional neural network based fault detection for rotating machinery. J. Sound Vib., 2016, 377: 331-345.

105 T. Bai, L. Zhang, L. Duan, J. Wang. NSCT-based infrared image enhancement method for rotating machinery fault diagnosis. IEEE Trans.Instrum. Meas., 2016, 65, 2293-2301.

106 O. Janssens, R. V. de Walle, M. Loccufier, S. V. Hoecke. Deep learning for infrared thermal image based machine health monitoring. IEEE/ASME Trans. Mechatronics, 2018, 23, 151-159.

107 D. Lopez-Perez, J. Antonino-Daviu. Application of infrared thermography to failure detection in industrial induction motors: Case stories. IEEE Trans. Ind. Appl. 2017, 53, 1901-1908.

108 O. Janssens, M. Loccufier, S. V. Hoecke. Thermal Imaging and Vibration-Based Multisensor Fault Detection for Rotating Machinery. IEEE TRANSACTIONS ON INDUSTRIAL INFORMATICS, 2019, 15: 434-444.

109 L.R. Jin, Study on synthetic diagnosis method of transformer fault using multi-neural network and evidence theory, Proc. CSEE, 2006, 26: 119-124.

110 X. W. Zhang, H. S. Li. Research on transformer fault diagnosis method and calculation model by using fuzzy data fusion in multi-sensor detection system. 2019, International Journal for Light and Electron Optics, 2019, 176: 716-723.

111 G. M. Zhang. ANALYSISOF detection performance of infrared image sequence based ONMULTI-SENSOR Data Fusion Algorithm. J. Infrared Millim. Waves, 2009, 27: 16-19.

112 L. J. Xie. A fault diagnosis method of power transformers by integrated set pair analysis and association rules. Proc. CSEE, 2015, 35: 277-285.

113 H. Zhang, B. J. Zhao, L. B. Tang. Infrared object tracking based on adaptive multi-features integration. Acta Optica Sinica, 2010, 30: 1291-1296.

114 Y. Zhou, L. L. Chang, B. Qian. A belief-rule-based model for information fusion with insufficient multi-sensor data and domain knowledge using evolutionary algorithms with operator recommendations. Soft Computing, 2019, 23:5129-5142.

115 L. Q. Li, S. M Xie, J. M Ning. Evaluating green tea quality based on multi-sensor data fusion combining hyperspectral imaging and olfactory visualization systems. Journal of the science of food and agriculture, 2019, 99: 1787-1794.

116 F. Y. Kong, Y. F. Zhou, G. Chen. Multimedia data fusion method based on wireless sensor network in intelligent transportation system. Multimedia Tools and Applications, 2019,4:1-13.

117 R. Ambra, R. Di., L. Francesco, S. Carmelo. Botanical origin identification of Sicilian honeys based on artificial senses and multi-sensor data fusion. European Food Research & Technology, 2018, 244:1-9.

118 W. L. Yong. Identification algorithm of longitudinal road slope based on multi-sensor data fusion filtering. Journal of Mechanical Engineering, 2018, 54:116.

119 Y. H. Xu, B. Du, L. P. Zhang. Advanced multi-sensor optical remote sensing for urban land use and land cover classification: outcome of the 2018 IEEE GRSS data fusion contest. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2019, 99:1-16.

120 F. Santos, P. Meneses, P. Hostert. Monitoring long-term forest dynamics with scarce data: a multi-date classification implementation in the Ecuadorian Amazon. European Journal of Remote Sensing, 2018:1-17.

121 S. L. Gong, Design of data fusion algorithm in electrochemical gas sensor. Journal of Nanoelectronics & Optoelectronics, 2018, 13:610-616.

122 Y. X. Zhu, Y. C. Bo, J. Z. Zhang. Fusion of multi-sensor SSTs based on the spatiotemporal hierarchical bayesian model. Journal of Atmospheric & Oceanic Technology, 2018, 35:91-109.

123 X. Y. Zhang, J. L. Huang, G. H. Wang. Multi-radar data association of hypersonic target by LFM radar. Acta Electronica Sinica, 2018, 46:210-217.

124 A. Jain, V. Kanhangad. Human activity classification in smartphones using accelerometer and gyroscope Sensors. IEEE Sensors Journal, 2018, 18(3):1169-1177.

125 L. F. Yan, C. Minshan, P. Saurabh. Joint euclidean and angular distance-based embeddings for multisource image analysis. IEEE Geoscience and Remote Sensing Letters, 2018, 15:1110-1114.

126 Xing Z, Xia Y, Yan L, et al. Multisensor Distributed Weighted Kalman Filter Fusion With Network Delays, Stochastic Uncertainties, Autocorrelated, and Cross-Correlated Noises J. 2018, 48(5):716-726.

127 A. Kushwah, S. Kumar, R. M. Hegde. Multi-sensor data fusion methods for indoor activity recognition using temporal evidence theory. Pervasive and Mobile Computing,2015,21:19-29.

128 R. C. Luo, C. C. Chang, C. C.Lai. Multisensor fusion and integration: theories, applications, and its perspectives. IEEE Sensors Journal,2011,11:3122-3138.

129 M. S. Wang, C. Perera, P. P. Jayaraman. City data fusion: Sensor data fusion in the internet of things. International Journal of Distributed Systems and Technologies, 2015, 7:15-36.

130 P. X. Zhu. Application in data fusion of internet of things based on the KL distance of reputation model. Advanced Materials Research, 2013:587-591.

131 B. Khaleghi, A. Khamis, F. O. Karray. Multisensor data fusion: A review of the state-of-the-art. Information Fusion, 2013, 14:28-44.

132 S. A. Rizvi, N. M. Nasrabadi. Fusion techniques for automatic target recognition. Applied Imagery Pattern Recognition Workshop, 2003,10.

133 H. Y. Chen, J. B. Yang, P. Chen. Saliency Fusion of Multispectral Images With Non-uniform Texture and Complex Surface Defects. Journal of Beijing University of Technology, 2020, 1: 49-55.

134 Z. Ning, F.Li, W.Sheng. Pyroelectric infrared sensors for human identification using non-negative matrix factorization and BP neural network. Advances in Intelligent & Soft Computing, 2011,122:685-690.

135 C. Wang, S.Qin. Adaptive detection method of infrared small target based on target-background separation via robust principal component analysis. Infrared Physics & Technology, 2015,69:123-135.

136 Y. Y. Ting, H. S. Wang. Develop a multi-detection security system using multi-sensor fusion algorithms. Artificial Life and Robotics, 2013,18:83-88.

137 Y. Dai, Y. Wu. Reweighted infrared patch-tensor model with both non-local and local priors for single-frame small target detection. IEEE Journal of Selected Topics in Applied Earth Observations& Remote Sensing, 2017, 10:3752-3767.

138 Z. C. Liang. Surface defect detection system based on convolution neural network. Hangzhou, Zhejiang University, 2018.

139 F. Andre, R. Vaillon. Generalization of the k-moment method using the maximum entropy principle. Application to the NBKM and full spectrum SLMB gas radiation models. Journal of Quantitative Spectroscopy& Radiative Transfer, 2012, 113: 1508-1520.

140 Y. Zhang, Y.P. Zhu. Application and improvement of decision template method in target recognition of decision layer fusion. Electrooptic and control, 2005,12: 16-19.

141 Y. Zhang, Y. P. Zhu, Y. W. Fu. Modification and application of decision template method in decision-level fusion for target recognition. Electronics Optics &Control, 2005,12:16-19.

142 L. H. Study of image fusion algorithm to edge erosion of titanium alloy with DR detection. Nachang, Nanchang Hangkong University,2015.

143 D.J. Kemley. Notes on the use of D-S and fuzzy reasoning to fuse identity attribute data. Surveillance Research Laboratory,1992.

144 L. Roux, J. Desachy. Information fusion for supervised classification in a satellite image. International Joint Conference of the Fourth IEEE International Conference on Fuzzy Systems and The Second International Fuzzy Engineering Symposium, 1995:1119-1125.

145 J. X. Yang. Z. H. Shi. Objective recognition fusion algorithm based on fuzzy synthesis function method study. Radar Technology, 2004 (33): 11-13.

146 Y. X. Liu, X. li, Z. W. Zhuang. Decision level based on Choquet fuzzy integral information fusion target identification. Electronics and information technology, 2003,25:695-699.

147 X. L. Wu. Micro quality inspection technology of stone surface. Shenyang, Shenyang University of Technology, 2017.

148 M. Ashtiyani, L. S. Navaei, A. Asgharzadeh. M. R. Deevband. Heart Rate Variability Classification using Support Vector Machine and Genetic Algorithm. Journal of biomedical physics & engineering,2018,8(4).

149 L. H. Zhu, G. Q. Ni. Feature optimization for multi-sensor target recognition system. Optical Technique, 2005,31: 420-426.

150 H. Liu. Three-Dimensional reconstruction of surface crack based on digital image processing. Changchun, Changchun University of Science and Technology, 2012.

151 H. Zhu, W. Wang, C.Wang. Robust track-to-track association in the presence of sensor biases and missed detections. Information Fusion,2016,27:33-40.

152 D. Fisch, E. Kalkowski, B. Sick. Knowledge fusion for probabilistic generative classifiers with data mining applications. IEEE Transactions on Knowledge and Data Engineering, 2014,26:652-666.

153 X. Dong, E.Gabrilovich, G.Heitz. Knowledge vault: a web-scale approach to probabilistic knowledge fusion. Proceedings of the 20th ACM SIGKDD international conference on Knowledge discovery and data mining, 2014:601-610.

下载:

下载: